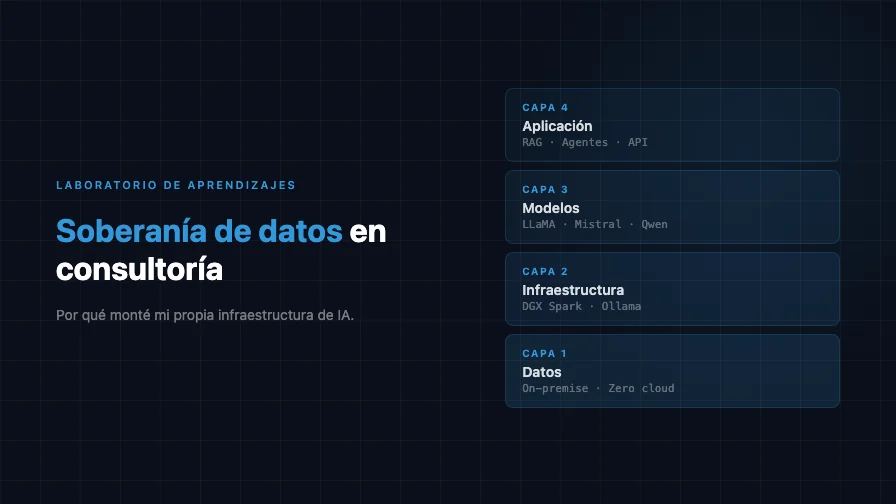

Soberanía de datos en consultoría: ¿por qué monté mi propia infraestructura de IA?

Por qué montar infraestructura propia de IA en consultoría. Regulación, arquitectura RAG local, modelos open-source y el trade-off soberanía vs costo.

La mayoría de las implementaciones de inteligencia artificial en consultoría organizacional dependen de APIs de terceros: OpenAI, Anthropic, Google. El consultor envía datos del cliente a un servidor externo, recibe una respuesta procesada, y la integra en su entregable. El modelo funciona bien para muchos casos. No funciona para todos.

En sectores regulados — banca, seguros, energía, operaciones gubernamentales — el flujo de datos hacia proveedores externos enfrenta restricciones que no son técnicas sino regulatorias y contractuales. Un banco cuya superintendencia establece requisitos sobre el tratamiento de datos de clientes puede tener limitaciones para enviar información a APIs cuyos servidores están en jurisdicciones diferentes. Una aseguradora que procesa datos de salud está sujeta a regulaciones de protección de datos personales que establecen obligaciones sobre localización, acceso y trazabilidad. Una autoridad gubernamental que maneja documentación clasificada o sensible simplemente no puede procesar esa documentación a través de servicios externos.

Estas restricciones no son arbitrarias. Responden a principios legítimos de protección de datos y soberanía informacional que el Reglamento General de Protección de Datos (GDPR) de la UE formalizó y que legislaciones en América Latina han adoptado con diferentes grados de rigurosidad. La Ley 81 de 2019 en Panamá, la Ley Federal de Protección de Datos Personales en Posesión de los Particulares en México, y regulaciones análogas en Colombia, Chile y Costa Rica establecen marcos que, interpretados estrictamente, limitan el flujo transfronterizo de datos personales y sensibles.

La pregunta práctica para un consultor que trabaja con IA en estos sectores no es si la IA agrega valor — generalmente lo hace — sino cómo implementar capacidades de IA que cumplan con las restricciones regulatorias del cliente sin sacrificar la funcionalidad analítica que justifica su uso.

La respuesta que adoptó la comunidad de código abierto fue predictable: modelos que pueden ejecutarse localmente. Proyectos como Llama (Meta), Mistral, Qwen (Alibaba) y sus derivados han producido modelos de lenguaje que, si bien no alcanzan la capacidad de los modelos más grandes servidos por API, ofrecen rendimiento suficiente para muchas tareas organizacionales. Ollama y otros runtimes permiten ejecutar estos modelos en hardware local con configuración relativamente simple. La pregunta dejó de ser si es técnicamente posible ejecutar IA localmente y pasó a ser si es prácticamente viable para un consultor independiente o una firma pequeña.

La viabilidad depende de tres factores: hardware, arquitectura de software y competencia técnica.

El hardware para inferencia local de modelos de lenguaje ha evolucionado significativamente. Las GPUs de consumo (NVIDIA RTX serie 40 y 50) pueden ejecutar modelos de 7-14 mil millones de parámetros con latencia aceptable para uso interactivo. Hardware más especializado como los sistemas DGX de NVIDIA permite ejecutar modelos más grandes y procesar volúmenes mayores, pero representa una inversión considerable. Para una consultora boutique, la decisión de inversión en hardware depende del volumen de trabajo que justifique la capacidad local versus el uso ocasional que podría resolverse con APIs (para los datos no sensibles) o con procesamiento manual.

Ziegler et al. (2019) documentaron que los modelos de lenguaje más pequeños, cuando se ajustan a dominios específicos mediante fine-tuning o se complementan con retrieval, pueden alcanzar rendimiento comparable a modelos mucho más grandes en tareas especializadas. Esto tiene implicaciones directas para el caso de uso en consultoría: un modelo de 8 mil millones de parámetros, combinado con un sistema de recuperación de información (RAG) alimentado con documentación específica del sector, puede responder preguntas sobre regulación bancaria panameña con mayor precisión que un modelo de propósito general de 70 mil millones de parámetros que no tiene acceso a esa documentación.

La arquitectura RAG (Retrieval-Augmented Generation), descrita formalmente por Lewis et al. (2020), complementa el modelo de lenguaje con una base de conocimiento que se consulta en tiempo real. En lugar de depender exclusivamente de lo que el modelo “aprendió” durante su entrenamiento, el sistema recupera documentos relevantes de una base de datos vectorial y los incluye como contexto para la generación. Bases de datos vectoriales como Qdrant, ChromaDB o Milvus permiten indexar documentos del cliente — políticas, regulaciones, manuales de proceso, actas de reunión — y hacerlos accesibles al modelo sin que los documentos salgan del perímetro de seguridad.

Para un consultor que trabaja con documentación sensible de clientes regulados, esta arquitectura resuelve el problema fundamental: los datos del cliente permanecen en infraestructura controlada (ya sea del cliente o del consultor), el modelo procesa localmente, y los resultados se generan sin que los datos transiten por servidores de terceros. El cumplimiento regulatorio se simplifica porque la cadena de custodia del dato es clara y auditable.

El Model Context Protocol (MCP), introducido por Anthropic, estandariza la forma en que los modelos de lenguaje interactúan con fuentes de datos externas, herramientas y servicios. Esto permite construir flujos de trabajo donde el modelo consulta bases de datos, ejecuta análisis y genera reportes de forma integrada, sin requerir desarrollo de integraciones ad hoc para cada fuente de datos. Para un consultor que necesita conectar un modelo con el ERP del cliente, su sistema de gestión documental y sus bases de datos de indicadores, el MCP reduce significativamente la complejidad de integración.

La competencia técnica necesaria para operar esta infraestructura es el factor limitante más significativo. Configurar un stack de inferencia local con RAG y servidores MCP requiere conocimiento de administración de sistemas Linux, redes, gestión de contenedores (Docker), programación en Python, y conceptos de MLOps que la mayoría de los consultores organizacionales no poseen —una brecha entre capas de competencia que examinamos en la falacia del experto en IA empresarial. La brecha entre “puedo usar ChatGPT” y “puedo operar mi propia infraestructura de IA” es considerable y no está disminuyendo — los sistemas se vuelven más capaces pero no necesariamente más simples de operar.

Esto crea una barrera de entrada que es simultáneamente una ventaja competitiva. El consultor que opera su propia infraestructura de IA puede atender clientes que sus competidores no pueden, porque sus competidores dependen de APIs que esos clientes no pueden usar. Pero esa ventaja se sostiene solo mientras la barrera técnica exista — si los proveedores cloud desarrollan soluciones de IA regulatoriamente compliant que eliminan la necesidad de infraestructura local, la ventaja desaparece.

Floridi y Taddeo (2016) argumentaron que la soberanía informacional — el control de un actor sobre los datos que le conciernen — es un concepto políticamente relevante que trasciende la discusión técnica sobre dónde se almacenan los bits. La soberanía de datos no es solo un problema de cumplimiento regulatorio — es una cuestión de poder organizacional. Cuando los datos de análisis organizacional de un banco son procesados por un proveedor externo de IA, existe una asimetría de información: el proveedor tiene acceso a patrones agregados de múltiples clientes que el banco individual no puede observar. Esta asimetría puede ser benigna — el proveedor usa los patrones para mejorar su servicio — o puede ser problemática, dependiendo de las políticas de uso de datos del proveedor y del marco regulatorio aplicable.

La discusión sobre soberanía de datos en IA tiene paralelos con debates anteriores sobre outsourcing de infraestructura tecnológica. Willcocks, Lacity y Kern (1999) documentaron que las organizaciones que externalizaron sus capacidades de TI sin retener competencia interna para evaluar y gobernar a sus proveedores terminaron en posiciones de dependencia donde no podían verificar la calidad del servicio ni cambiar de proveedor sin costos prohibitivos. El mismo riesgo aplica a la dependencia de proveedores de IA: una organización que procesa toda su analítica a través de una API externa no desarrolla la capacidad interna para evaluar la calidad de los resultados, detectar sesgos en los modelos, ni migrar a alternativas cuando las condiciones cambien.

Hay un argumento contrario que merece consideración: mantener infraestructura propia tiene costos de oportunidad. El tiempo dedicado a actualizar modelos, mantener servidores, resolver problemas de configuración y mantenerse al día con la evolución del ecosistema de código abierto es tiempo que no se dedica a trabajar con clientes. Para un consultor independiente, la ecuación es particularmente delicada: cada hora dedicada a infraestructura es una hora no facturada. La decisión racional no es “infraestructura propia siempre” ni “API siempre” sino una evaluación pragmática de qué datos requieren procesamiento local (los sensibles y regulados) y cuáles pueden procesarse externamente (los públicos, los genéricos, los de bajo riesgo).

La arquitectura híbrida — modelos locales para datos sensibles, APIs externas para tareas de propósito general — es probablemente la configuración más sostenible para una consultora que opera en sectores regulados sin tener el presupuesto de un departamento de TI. Pero requiere la capacidad técnica para operar ambos entornos y la disciplina para clasificar correctamente qué datos van por qué canal — una decisión que no puede automatizarse completamente porque depende del contexto regulatorio del cliente, que varía por sector, jurisdicción y sensibilidad del dato específico.

Zuboff (2019), en “The Age of Surveillance Capitalism,” argumentó que la extracción de datos es el modelo de negocio dominante de la economía digital y que la privacidad requiere no solo regulación sino capacidad técnica para ejercerla. Para las organizaciones que son clientes de consultoría, la capacidad de procesar sus datos de forma soberana — sin exponerlos a terceros cuyo modelo de negocio puede incluir la explotación de esos datos — es una forma concreta de ejercer esa capacidad. El consultor que puede ofrecer esa opción no está vendiendo tecnología — está vendiendo una garantía que tiene valor comercial y regulatorio cuantificable.

La evolución del hardware y del software de código abierto está haciendo que esta opción sea cada vez más accesible. Modelos como Llama 3.1 de 70 mil millones de parámetros corren en hardware que cuesta una fracción de lo que costaba hace tres años. Las herramientas de orquestación se simplifican con cada iteración. El ecosistema de embeddings y bases vectoriales se ha consolidado alrededor de estándares que facilitan la interoperabilidad. Pero “más accesible” no es lo mismo que “accesible para cualquiera.” La brecha entre usar IA y operar IA sigue siendo significativa, y la velocidad de cambio del ecosistema — nuevos modelos cada mes, nuevas arquitecturas cada trimestre — requiere una inversión continua en actualización técnica que no todos los consultores están dispuestos o capacitados para hacer.

La decisión de montar infraestructura propia de IA para consultoría no es una decisión tecnológica. Es una decisión de modelo de negocio que responde a una pregunta específica: ¿los clientes que necesito atender pueden enviar sus datos a servidores externos? Si la respuesta es sí para todos, la infraestructura propia es un costo innecesario. Si la respuesta es no para los clientes más valiosos — los bancos, las aseguradoras, las autoridades regulatorias, las operaciones gubernamentales — entonces la infraestructura propia no es un gasto sino una capacidad habilitadora que abre un segmento de mercado al que los competidores sin esa capacidad no pueden acceder. La tecnología es el medio; la decisión estratégica es el fin.

Referencias

- Floridi, L., & Taddeo, M. (2016). What is data ethics? Philosophical Transactions of the Royal Society A, 374(2083), 20160360.

- Lewis, P., Perez, E., Piktus, A., et al. (2020). Retrieval-augmented generation for knowledge-intensive NLP tasks. Advances in Neural Information Processing Systems, 33, 9459-9474.

- Willcocks, L. P., Lacity, M. C., & Kern, T. (1999). Risk mitigation in IT outsourcing strategy revisited: Longitudinal case research at LISA. The Journal of Strategic Information Systems, 8(3), 285-314.

- Ziegler, D. M., Stiennon, N., Wu, J., et al. (2019). Fine-tuning language models from human preferences. arXiv preprint arXiv:1909.08593.

- Zuboff, S. (2019). The Age of Surveillance Capitalism: The Fight for a Human Future at the New Frontier of Power. PublicAffairs.