Anatomía de una Intervención Organizacional: De los Datos al Primer Cambio Visible

El período más peligroso de una transformación es entre el diagnóstico y la primera acción visible. La organización necesita ver un cambio concreto en los primeros 30 días o la credibilidad del proceso se erosiona irreversiblemente.

Hay un momento preciso en el que una transformación organizacional muere. No es cuando la resistencia se organiza, ni cuando el presupuesto se recorta, ni cuando el sponsor ejecutivo pierde interés. Es antes. Es el momento en que la organización tiene los datos del diagnóstico sobre la mesa, sabe exactamente qué está mal, y no hace nada visible al respecto. No porque no quiera. Porque está “procesando,” “analizando,” “diseñando el plan.” Y mientras la organización procesa, analiza y diseña, las personas que respondieron la encuesta, que participaron en los focus groups, que invirtieron tiempo y credibilidad en el proceso, están observando. Esperando. Calculando si esta vez será diferente o si es otra ronda de diagnósticos que termina en un informe archivado junto a los anteriores.

Este artículo cierra un arco de dos semanas que hemos construido deliberadamente. La primera semana construimos la base: examinamos qué es lo que realmente medimos cuando medimos clima, cómo la gobernanza de decisiones conecta estructura con percepción, por qué los perfiles de compromiso importan más que los promedios, cuánta varianza en clima explica el liderazgo, la diferencia entre procesos que protegen y procesos que paralizan, la conexión entre clima y predicción de rotación, y cómo pasar de la encuesta a un sistema de inteligencia organizacional. La segunda semana pasó del diagnóstico a la acción: por qué algunos equipos aprenden mientras otros repiten, la superioridad de la retroalimentación continua sobre el feedback anual, el papel del conocimiento tácito como activo invisible, y un framework para decidir qué cambiar primero.

Ahora viene la pregunta que lo conecta todo: tenemos los datos, tenemos el marco de priorización, tenemos la intención. ¿Cómo cruzamos el abismo entre saber y hacer sin perder la credibilidad que el proceso de diagnóstico construyó?

La trampa del diagnóstico perpetuo

En nuestra experiencia trabajando con organizaciones en Panamá y Centroamérica, hemos observado un patrón que se repite con suficiente frecuencia como para merecer un nombre: la trampa del diagnóstico perpetuo. La organización reconoce que tiene un problema. Contrata un diagnóstico. Recibe los resultados. Los resultados confirman lo que muchos ya intuían pero que nadie había articulado con datos. Hasta aquí, el proceso funciona. Luego ocurre algo predecible: la dirección decide que necesita “profundizar” antes de actuar. Se encarga un segundo estudio. Se forman comités para analizar los hallazgos. Se solicitan benchmarks. Se piden mejores prácticas de la industria. Se programa un offsite para “priorizar.” Y la organización entra en un ciclo de actividad intensa que tiene la apariencia de progreso pero que, en realidad, es una forma sofisticada de evitar la acción.

La trampa es seductora porque cada paso individual parece razonable. ¿Quién argumentaría en contra de profundizar el análisis? ¿Quién se opondría a consultar benchmarks? ¿Quién diría que un offsite de priorización es mala idea? Cada decisión de postergar está envuelta en lenguaje de rigor y prudencia. Pero el efecto acumulativo es devastador: la organización gasta meses en una zona de confort intelectual donde entiende el problema cada vez mejor y lo resuelve cada vez menos.

Robert Schaffer y Harvey Thomson (1992) diagnosticaron este fenómeno hace más de tres décadas en su artículo seminal en Harvard Business Review, “Successful Change Programs Begin with Results.” Su argumento era tan incómodo entonces como ahora: la mayoría de los programas de cambio organizacional fracasan no porque el diagnóstico sea incorrecto, sino porque se diseñan como programas de actividad en lugar de programas de resultados. La organización define lo que va a hacer — implementar un nuevo sistema de comunicación, rediseñar el proceso de evaluación, capacitar a los líderes en feedback — en lugar de definir qué resultado espera obtener en un plazo específico. La actividad se convierte en fin, no en medio. Y cuando los resultados no llegan, la respuesta es más actividad, no diferente actividad.

Schaffer y Thomson propusieron una inversión radical del proceso: empezar por el resultado deseado, no por el programa. En lugar de diseñar una “iniciativa de mejora de clima” con 15 acciones a 18 meses, identificar un resultado específico — reducir el tiempo de respuesta a clientes internos de 48 a 24 horas en el Departamento X dentro de 60 días — y trabajar hacia atrás desde ahí. El resultado define la actividad, no al revés. Y el resultado es visible, medible, y lo suficientemente cercano en el tiempo como para que la organización pueda verificar si el cambio está funcionando antes de haber invertido meses de esfuerzo en un programa que podría ser la solución equivocada al problema equivocado.

El error fundamental: tratar problemas adaptativos con soluciones técnicas

Ronald Heifetz y Marty Linsky (2002) hicieron una distinción que, en nuestra práctica, se ha convertido en la herramienta diagnóstica más útil que tenemos: la diferencia entre desafíos técnicos y desafíos adaptativos. Un desafío técnico es aquel para el cual la solución ya existe y se puede implementar con conocimiento y procedimientos conocidos. La máquina se descompone; el técnico la repara. El proceso tiene un cuello de botella; se rediseña el flujo. El sistema de información está desactualizado; se implementa uno nuevo. La solución puede ser difícil de ejecutar, pero el problema está bien definido y la respuesta es conocida.

Un desafío adaptativo es fundamentalmente diferente. La solución requiere que las personas cambien sus valores, creencias, hábitos o formas de trabajar. No hay un experto que tenga la respuesta porque la respuesta no existe independientemente de las personas que necesitan cambiar. El líder que microgestiona no lo hace porque desconozca técnicas de delegación — las conoce perfectamente — sino porque tiene una creencia profunda de que si no controla cada detalle, las cosas saldrán mal. El equipo que no colabora entre áreas no lo hace porque falte un proceso de coordinación — hay tres procesos documentados — sino porque cada área ha aprendido que proteger su territorio es más seguro que exponerse. La organización que no innova no carece de un programa de innovación — tiene dos — sino que su cultura penaliza el error y premia la conformidad.

La distinción importa porque la intervención que funciona para un desafío técnico no solo no funciona para un desafío adaptativo — lo empeora. Cuando se aplica una solución técnica a un problema adaptativo, se genera la ilusión de que el problema se está atendiendo mientras las causas profundas permanecen intactas. Se implementa un “programa de delegación” para el líder que microgestiona, y el líder asiste al taller, aprende las técnicas, las aplica durante dos semanas, y vuelve a su patrón anterior porque las creencias que sostienen el comportamiento nunca fueron tocadas. Se instala un “proceso de coordinación interáreas” y las áreas cumplen el proceso formalmente mientras continúan operando en silos porque los incentivos que premian el comportamiento territorial nunca cambiaron.

En el contexto de las intervenciones que nacen de un diagnóstico de clima, esta distinción es crítica. El diagnóstico revelará problemas de ambos tipos. “Los equipos no tienen las herramientas adecuadas para colaborar remotamente” es un desafío técnico: se seleccionan e implementan las herramientas. “Los líderes no confían en sus equipos lo suficiente como para darles autonomía real” es un desafío adaptativo: no se resuelve con un taller de “empoderamiento” ni con un cambio de política, sino con un proceso sostenido que confronta las creencias y los incentivos que producen el comportamiento actual. La primera acción del equipo de intervención debe ser clasificar los hallazgos del diagnóstico en estas dos categorías, porque la estrategia, el timeline y las expectativas son radicalmente diferentes para cada una.

Hemos explorado esta tensión al examinar cómo distinguir entre procesos que protegen y procesos que paralizan. Los procesos que paralizan son, frecuentemente, soluciones técnicas que se acumularon para abordar lo que eran, en su origen, desafíos adaptativos no reconocidos. Cada capa de burocracia fue una respuesta técnica a una falla de confianza, coordinación o juicio — problemas adaptativos que la burocracia nunca resolvió y que, con el tiempo, la propia burocracia ocultó.

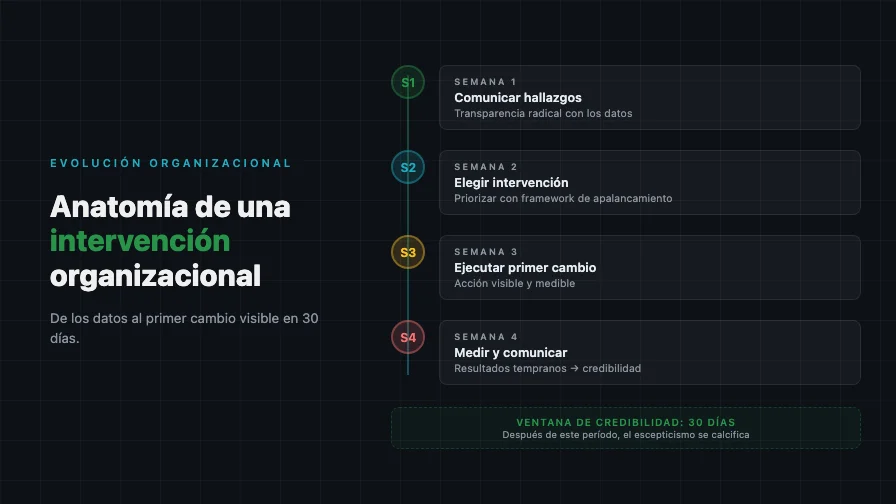

Anatomía de los primeros 30 días

Si los datos del diagnóstico son el combustible y el framework de priorización es el mapa, los primeros 30 días son el tramo de la ruta donde se decide si el vehículo llega a destino o se detiene al costado del camino. Hemos aprendido — a veces por las buenas, frecuentemente por las malas — que este período tiene una estructura interna que conviene respetar.

Semana 1: Comunicar los hallazgos con transparencia radical

La primera tentación después de recibir los resultados del diagnóstico es editarlos. Suavizar los hallazgos incómodos. Presentar las áreas de mejora sin nombrar las áreas específicas donde los problemas son más agudos. Usar promedios corporativos en lugar de datos por equipo. Convertir el diagnóstico en un ejercicio diplomático que no incomode a nadie.

Esta tentación es comprensible — la presentación de resultados tiene dimensiones políticas reales — pero ceder a ella tiene un costo enorme. Las personas que participaron en el diagnóstico saben qué dijeron. Cuando reciben una versión sanitizada de la realidad que ellos mismos reportaron, el mensaje implícito es claro: la organización preguntó pero no quiere escuchar la respuesta. Y si la organización no quiere escuchar la respuesta, ¿por qué habrían de participar la próxima vez? La falta de transparencia en la devolución de resultados es la forma más eficiente de destruir la participación futura — y con ella, la capacidad del sistema de inteligencia organizacional que con tanto esfuerzo se construyó.

La transparencia radical no significa brutalidad comunicacional. Significa presentar los datos como son, con contexto y sin eufemismos, pero con un marco que conecte cada hallazgo con una acción concreta. No es lo mismo decir “el Departamento X tiene los peores índices de clima de la organización” que decir “el Departamento X enfrenta desafíos específicos en autonomía percibida y reconocimiento que vamos a abordar con intervenciones concretas que anunciaremos la próxima semana.” La primera formulación es un señalamiento; la segunda es un compromiso. Ambas son transparentes, pero solo la segunda genera expectativa constructiva en lugar de defensividad.

Kurt Lewin, en su modelo clásico de cambio que sigue siendo más útil de lo que su antigüedad sugiere, llamó a este momento “descongelamiento.” El descongelamiento no es una metáfora vaga sobre preparar a la organización para el cambio — es el proceso específico por el cual las personas reconocen que el estado actual es insostenible y desarrollan disposición para explorar alternativas. Los datos del diagnóstico son la herramienta de descongelamiento más poderosa que existe, pero solo si se comparten con suficiente honestidad como para que las personas reconozcan su realidad en los números. Cuando la presentación es tan pulida que la realidad desaparece detrás de los gráficos, el descongelamiento no ocurre — y sin descongelamiento, la resistencia al cambio no es un obstáculo sino una respuesta racional de personas que no ven razón para cambiar.

En nuestra práctica, la comunicación de hallazgos de la primera semana incluye tres elementos no negociables: los datos agregados y desagregados por unidad (con las protecciones de privacidad y anonimato que el diseño del instrumento debe garantizar, como exploramos al analizar la importancia de la privacidad en equipos pequeños), las tres prioridades de intervención que emergen de los datos (no quince, no ocho — tres), y el timeline de las próximas acciones, con fechas y responsables. El tercer elemento es el que la mayoría de las organizaciones omite, y es el más importante: dice “esto no es otro informe que va al cajón.”

Semana 2: Identificar y anunciar la primera intervención

La segunda semana es donde el framework de priorización que examinamos en el artículo sobre qué cambiar primero se pone a prueba. De las tres prioridades comunicadas, una debe seleccionarse para la primera intervención — y la selección no obedece necesariamente al problema más grave sino al problema que ofrece la mejor combinación de tres criterios.

El primer criterio es impacto visible. La intervención debe producir un cambio que las personas afectadas puedan percibir directamente en su experiencia cotidiana de trabajo. Un cambio en la política de aprobaciones que reduce los niveles de firma de cuatro a dos es visible. Un cambio en la estrategia de talento de largo plazo no lo es — por más importante que sea. En este momento del proceso, la visibilidad no es vanidad; es evidencia de que algo cambió.

El segundo criterio es factibilidad en el corto plazo. La intervención debe poder ejecutarse en una o dos semanas, no en un trimestre. Esto significa que las primeras intervenciones son casi siempre cambios técnicos, no adaptativos — una eliminación de un proceso redundante, una modificación de una política que generaba frustración, una reasignación de recursos que desbloqueaba un cuello de botella. Los desafíos adaptativos, por su naturaleza, requieren tiempo. Pero las quick wins técnicas crean el espacio de credibilidad que permite abordar los problemas adaptativos más adelante.

El tercer criterio es conexión con el diagnóstico. La intervención debe ser claramente atribuible a lo que los datos revelaron. Si la encuesta mostró que la falta de reconocimiento era un tema crítico y la primera intervención es rediseñar el proceso de reportes, la organización no ve la conexión — por más que el equipo de intervención tenga razones válidas para priorizar los reportes. La narrativa importa: las personas necesitan ver que el diagnóstico produjo acción sobre lo que el diagnóstico identificó.

John Kotter (1996) articuló este principio con claridad en su modelo de ocho pasos para el cambio: las quick wins no son opcionales ni son un truco motivacional. Son la evidencia empírica que la organización necesita para creer que el cambio es posible. Sin quick wins tempranas, el proceso de cambio depende enteramente de la credibilidad del liderazgo y de la confianza en la promesa de que los resultados llegarán eventualmente. En organizaciones que han pasado por transformaciones fallidas anteriores — y en nuestra experiencia en la región, eso incluye a la mayoría — esa confianza es un recurso agotado. Las quick wins la reconstruyen, de a una.

Semana 3: Ejecutar el primer cambio visible

La ejecución de la primera intervención tiene una dimensión operativa y una dimensión simbólica, y ambas importan. La dimensión operativa es la implementación del cambio en sí — el proceso se elimina, la política se modifica, el recurso se reasigna. La dimensión simbólica es cómo la organización percibe la ejecución: si fue rápida o lenta, si fue limpia o caótica, si fue decisiva o vacilante. La primera intervención es un statement sobre la naturaleza del proceso de cambio, y la organización la lee como tal.

Hemos observado que la ejecución de la primera intervención funciona mejor cuando se cumplen tres condiciones. La primera es que el sponsor ejecutivo esté visiblemente involucrado — no como observador sino como decisor. Si la primera intervención requiere eliminar un nivel de aprobación, es el sponsor quien anuncia la eliminación, no el consultor ni el área de recursos humanos. Esto comunica que el cambio tiene respaldo real, no delegado.

La segunda condición es que la implementación sea completa, no piloto. La tentación de “probar primero en un área” es razonable en intervenciones de gran escala, pero para la primera quick win es contraproducente. Un piloto comunica prudencia; una implementación completa comunica convicción. Y en este momento del proceso, la organización necesita ver convicción.

La tercera condición es que la implementación sea irreversible — o al menos, que requiera una decisión explícita para revertirla. Si el cambio se presenta como “temporal” o “experimental,” la organización no lo procesa como cambio sino como paréntesis. Los comportamientos no se modifican durante los paréntesis; se suspenden. La diferencia entre una organización que cambió un proceso y una organización que suspendió un proceso temporalmente es la diferencia entre cambio real y teatro organizacional.

Semana 4: Medir y comunicar resultados tempranos

La cuarta semana cierra el primer ciclo con una medición explícita del impacto de la intervención. Esta medición no necesita ser sofisticada — de hecho, la sofisticación en este punto puede ser contraproducente — pero sí necesita ser honesta y pública.

Si la intervención fue eliminar un nivel de aprobación, la medición es: ¿cuántos procesos se aprobaron en la semana previa a la intervención vs. en las dos semanas posteriores? ¿Cuánto se redujo el tiempo promedio de aprobación? ¿Cuántas horas-persona se liberaron? Estos números no necesitan ser estadísticamente significativos — el período es demasiado corto para eso — pero necesitan existir y ser comunicados, porque establecen un precedente: en este proceso, medimos lo que hacemos y compartimos lo que encontramos.

La comunicación de resultados tempranos cumple una función adicional que Kotter (1996) identificó: genera momentum. Las organizaciones no cambian por decreto ni por plan; cambian por acumulación de evidencia de que el cambio es posible y beneficioso. La primera intervención es un dato. La segunda intervención es un patrón. La tercera intervención es una tendencia. Cada ciclo de acción-medición-comunicación deposita credibilidad en una cuenta que la organización va a necesitar cuando llegue el momento de abordar los desafíos adaptativos — los que requieren que las personas cambien creencias, no solo procesos.

El modelo de Lewin actualizado: por qué el descongelamiento es lo más difícil

El modelo de Lewin — descongelar, cambiar, recongelar — se cita tan frecuentemente que ha perdido su poder explicativo. Se ha convertido en un cliché de presentaciones de gestión del cambio, reducido a tres flechas en un slide. Pero cuando se examina con seriedad, el modelo contiene una observación profunda que las dos semanas de esta serie han ido construyendo: el estado actual de una organización no es un estado neutro. Es un equilibrio activamente mantenido por fuerzas que resisten el cambio.

Lewin conceptualizó la organización como un campo de fuerzas en tensión: fuerzas impulsoras (las que empujan hacia el cambio) y fuerzas restrictivas (las que empujan hacia la estabilidad). El estado actual es el punto de equilibrio entre ambas. Lo que Lewin argumentó — y lo que la experiencia confirma consistentemente — es que el cambio no se produce aumentando las fuerzas impulsoras sino reduciendo las fuerzas restrictivas. Empujar más fuerte contra la resistencia produce más resistencia, no más cambio. Identificar y desmontar las barreras específicas que sostienen el estado actual produce cambio con menos fricción y mayor sostenibilidad.

Los datos de diagnóstico de clima son, en este marco, un mapa de las fuerzas restrictivas. Cuando la encuesta revela que los líderes de mandos medios perciben que la comunicación ejecutiva es opaca, ese dato no es solo una descripción de una percepción — es la identificación de una fuerza restrictiva. La opacidad comunicativa no solo genera insatisfacción; genera comportamientos defensivos, acumulación de información como moneda de poder, y resistencia a iniciativas que se perciben como decididas sin consulta. Si la intervención aborda directamente esa opacidad — no con un “plan de comunicación” sino con un cambio específico en cómo se comparten las decisiones y sus razones — está reduciendo una fuerza restrictiva, no empujando contra ella.

Esto conecta directamente con el sistema de inteligencia organizacional que describimos al cerrar la primera semana de la serie. Un sistema que integra datos de percepción, datos de RRHH, datos operativos y datos de red organizacional no solo diagnostica problemas — mapea fuerzas restrictivas. Cada punto de fricción que el sistema identifica es una fuerza que mantiene el status quo. Y cada fuerza restrictiva desmontada es un paso de descongelamiento que hace posible el cambio subsiguiente.

El “recongelamiento” — la fase final de Lewin — es igualmente incomprendida. No se trata de volver a un estado rígido después del cambio; se trata de institucionalizar las nuevas prácticas hasta que se conviertan en el nuevo equilibrio. En términos prácticos, esto significa integrar los cambios en procesos formales, sistemas de incentivos, rituales organizacionales y criterios de evaluación. Un cambio que depende de la voluntad individual para sostenerse no está recongelado — está suspendido, esperando a que la persona que lo sostiene se canse, se vaya o se distraiga.

La ventana de credibilidad

Existe un concepto que hemos construido a partir de la observación empírica más que de la literatura formal, y que se ha vuelto central en nuestra práctica: la ventana de credibilidad. Es el período de tiempo durante el cual una organización está dispuesta a creer que un proceso de cambio va a producir resultados antes de que el escepticismo se calcifique.

La duración de esta ventana varía según el contexto, pero en las organizaciones con las que hemos trabajado en la región, observamos un patrón consistente. Las primeras dos a tres semanas después del diagnóstico son de expectativa cautelosa: las personas esperan a ver qué pasa. Entre la tercera y la sexta semana, si no ha ocurrido nada visible, la expectativa se convierte en escepticismo activo: “otra vez lo mismo.” Después de la octava semana sin acción visible, el escepticismo se solidifica en cinismo: la organización no solo duda de esta iniciativa sino que incorpora la experiencia como evidencia de que las iniciativas de cambio no funcionan aquí.

El cinismo organizacional es cualitativamente diferente del escepticismo. El escepticismo se revierte con evidencia — una quick win en la semana cuatro puede revertir el escepticismo de la semana tres. El cinismo no se revierte con evidencia porque el cinismo incluye una teoría sobre por qué la evidencia no es confiable. “Sí, cambiaron el proceso de aprobaciones, pero es solo para que nos callemos — los problemas reales no los van a tocar.” El cinismo reinterpreta la evidencia positiva como manipulación, lo que la hace impermeabilizable. Recuperar una organización que ha cruzado el umbral del cinismo no es imposible, pero requiere un nivel de esfuerzo y consistencia exponencialmente mayor que actuar dentro de la ventana de credibilidad.

Kotter (1996) capturó una dimensión de este fenómeno con su insistencia en “crear un sentido de urgencia” como primer paso de cualquier proceso de cambio. La urgencia no es presión; es la percepción compartida de que el costo de no cambiar supera el costo de cambiar. Los datos del diagnóstico pueden crear esa urgencia si se presentan con la transparencia radical que describimos en la primera semana — pero la urgencia sin acción produce frustración, no cambio. Y la frustración, si se acumula, alimenta el cinismo.

La implicación práctica es directa: los primeros 30 días no son la fase de planificación del cambio. Son la fase de ejecución del primer cambio. La planificación debería haber ocurrido antes — durante el diseño del diagnóstico, cuando se definieron las decisiones que los datos informarían, cuando se construyó el framework de priorización. Si la organización llega al día posterior al diagnóstico sin un plan de acción inmediata, ya está retrasada respecto a su propia ventana de credibilidad.

Modos de falla en la transición diagnóstico-acción

Hemos observado suficientes transiciones fallidas como para catalogar los patrones más comunes. No son exhaustivos, pero cubren la mayoría de los fracasos que hemos presenciado.

El primer modo de falla es la parálisis por perfeccionismo. La organización quiere el plan perfecto antes de actuar. Se forma un comité para diseñar las intervenciones. El comité se reúne cada dos semanas. Las reuniones producen documentos que se revisan en la siguiente reunión. Después de tres meses, hay un plan de 40 páginas que nadie implementa porque, para entonces, la ventana de credibilidad se cerró y la organización ha pasado al siguiente tema. El perfeccionismo en la fase de planificación es, frecuentemente, una forma aceptable de evitar el riesgo inherente a la acción. Schaffer y Thomson (1992) lo describieron con precisión: las organizaciones prefieren la certeza de la planificación a la incertidumbre de la ejecución, incluso cuando la planificación excesiva produce resultados peores que la ejecución imperfecta.

El segundo modo de falla es la delegación descendente sin recursos. La dirección recibe el diagnóstico, identifica las áreas con peores indicadores, y les pide que diseñen sus propios planes de mejora. El mensaje implícito es: “el problema es de ustedes y la solución también.” Las áreas reciben la responsabilidad sin la autoridad, el presupuesto ni el tiempo necesario para generar cambio real. Los planes de mejora resultantes son ejercicios de cumplimiento, no de transformación — listas de actividades diseñadas para demostrar que se está haciendo algo, no para producir resultados diferentes.

El tercer modo de falla es la intervención desconectada del diagnóstico. La organización tenía un programa de capacitación en liderazgo planificado antes del diagnóstico. El diagnóstico revela problemas de coordinación interáreas y falta de claridad en roles. La organización implementa el programa de liderazgo de todas formas, lo presenta como respuesta al diagnóstico, y espera que la organización no note que la intervención no tiene relación con los hallazgos. La organización siempre lo nota. Y lo que nota no es solo la desconexión entre diagnóstico e intervención — nota que la dirección no tomó en serio el proceso.

El cuarto modo de falla es la sobreingeniería de la primera intervención. En lugar de una quick win visible y ejecutable en dos semanas, la organización diseña una intervención compleja, multidimensional, que involucra a múltiples áreas, requiere formación previa y tiene un timeline de seis meses. La intervención puede ser correcta en su diseño, pero es incorrecta en su timing. Los primeros 30 días no son para resolver el problema más complejo — son para demostrar que los problemas se están resolviendo.

Estos modos de falla no son mutuamente excluyentes. En nuestra experiencia, es frecuente observar dos o tres operando simultáneamente en la misma organización, reforzándose entre sí en una cascada que convierte el impulso del diagnóstico en inercia.

La síntesis: de medir a aprender

Estas dos semanas han construido, artículo por artículo, una metodología que no pretende ser original pero sí pretende ser coherente. Si tuviéramos que reducirla a un arco, tendría cinco fases.

La primera fase es Medir. No con un instrumento genérico sino con un sistema diseñado desde la pregunta “¿qué decisiones vamos a tomar?” hacia el dato necesario para tomarlas. Medir clima como percepción compartida, distinguiéndolo de satisfacción, engagement y cultura. Medir con la granularidad suficiente para detectar diferencias entre equipos. Medir con las protecciones necesarias para que las personas reporten su experiencia real, no la que creen que la organización quiere escuchar. Los artículos sobre qué medimos realmente, la varianza que explica el liderazgo y la conexión entre clima y rotación construyeron esta base.

La segunda fase es Interpretar. Los datos crudos no hablan por sí solos. Los promedios ocultan lo que la distribución de perfiles de compromiso revela. Las percepciones necesitan contexto operativo para distinguir entre síntomas y causas. La gobernanza de decisiones explica por qué los datos se ven como se ven. La distinción de Heifetz entre desafíos técnicos y adaptativos (Heifetz y Linsky, 2002) determina qué tipo de intervención puede funcionar para cada hallazgo.

La tercera fase es Priorizar. No todo se puede cambiar simultáneamente, y el orden importa. Los criterios que examinamos — impacto visible, factibilidad, conexión con el diagnóstico — no son los únicos posibles, pero son un punto de partida que hemos validado empíricamente. La distinción entre procesos que protegen y procesos que paralizan informa qué se puede eliminar rápidamente (quick wins técnicas) y qué requiere un trabajo sostenido de transformación cultural. El framework de qué cambiar primero proporciona la herramienta de priorización.

La cuarta fase es Actuar. Dentro de la ventana de credibilidad, con transparencia en la comunicación de hallazgos, con quick wins que demuestren que el diagnóstico produjo cambio real, y con un ciclo de medición-comunicación que deposite credibilidad. Kotter (1996) tenía razón: sin quick wins tempranas, la transformación depende de la fe — y la fe organizacional es un recurso agotable. Los equipos que aprenden en lugar de repetir son los que internalizan el ciclo de acción-medición-ajuste; los que lo externalizan, vuelven a sus patrones anteriores en cuanto la presión se relaja.

La quinta fase es Aprender. Toda intervención es una hipótesis: creemos que si cambiamos X, el resultado será Y. La medición posterior a la intervención no es auditoría; es validación de hipótesis. Si Y no ocurrió, la pregunta no es quién falló sino qué aprendimos sobre el sistema que no sabíamos antes. La retroalimentación continua es el mecanismo por el cual este aprendizaje se integra en la operación cotidiana, no como un evento periódico sino como una práctica permanente. Y el conocimiento tácito que emerge de cada ciclo de intervención es un activo que, si se captura, informa los ciclos subsiguientes con una riqueza que ningún diagnóstico externo puede igualar.

Este arco — Medir, Interpretar, Priorizar, Actuar, Aprender — no es lineal. Es iterativo. Cada ciclo completo produce mejor medición (porque ahora sabemos qué preguntar), mejor interpretación (porque tenemos contexto de intervenciones previas), mejor priorización (porque sabemos qué funciona aquí), mejor acción (porque la organización confía en el proceso), y mejor aprendizaje (porque el sistema de inteligencia organizacional es más maduro).

El sistema de inteligencia organizacional que describimos al cerrar la primera semana — las cuatro capas de datos de percepción, RRHH, operativos y de red — es la infraestructura que sostiene este arco. Sin esa infraestructura, cada ciclo empieza de cero. Con ella, cada ciclo empieza donde el anterior terminó.

Las organizaciones que cruzan el abismo

Las organizaciones que logran pasar del diagnóstico a la acción sostenida comparten tres características que no tienen que ver con su tamaño, su industria ni su presupuesto.

La primera es que tratan el diagnóstico como un compromiso, no como un ejercicio. Cuando una organización pide a sus personas que compartan su percepción, está haciendo una promesa implícita: “lo que nos digas importa y vamos a hacer algo al respecto.” Las organizaciones que cruzan el abismo honran esa promesa. Las que no lo hacen descubren, generalmente demasiado tarde, que la promesa incumplida tiene un costo mayor que el problema original.

La segunda es que distinguen entre velocidad y precipitación. Actúan rápido — dentro de la ventana de credibilidad — pero no actúan sin dirección. Tienen un framework de priorización que les permite seleccionar la primera intervención con criterio, no con impulso. Y tienen la disciplina de medir el resultado antes de escalar, no porque duden de su decisión sino porque respetan la complejidad del sistema que están interviniendo.

La tercera es que aceptan que la transformación es un proceso de aprendizaje, no de implementación. No tienen un plan maestro de 18 meses con 47 iniciativas. Tienen una hipótesis sobre qué cambio producirá qué resultado, un mecanismo para verificar si la hipótesis se cumplió, y la flexibilidad para ajustar cuando no se cumple. Las organizaciones que tratan la transformación como un proyecto con un Gantt chart predefinido se frustran cuando la realidad no sigue el cronograma. Las que la tratan como un proceso iterativo de hipótesis y validación se adaptan — y al adaptarse, aprenden. Y al aprender, cambian de verdad.

El abismo entre saber y hacer es real. Los datos del diagnóstico pueden ser impecables, el framework de priorización puede ser riguroso, la intención del liderazgo puede ser genuina. Y todo eso puede ser insuficiente si la organización no cruza la distancia entre la última diapositiva de la presentación de resultados y la primera acción visible que cambia la experiencia cotidiana de las personas que trabajan ahí.

Esa distancia se mide en días, no en meses. Y las organizaciones que la recorren a tiempo son las que transforman diagnósticos en resultados, datos en decisiones, y buenas intenciones en cambio real.

Referencias

- Heifetz, R. A. & Linsky, M. (2002). Leadership on the Line: Staying Alive Through the Dangers of Leading. Harvard Business School Press.

- Kotter, J. P. (1996). Leading Change. Harvard Business School Press.

- Lewin, K. (1947). Frontiers in group dynamics: Concept, method and reality in social science; social equilibria and social change. Human Relations, 1(1), 5-41.

- Schaffer, R. H. & Thomson, H. A. (1992). Successful change programs begin with results. Harvard Business Review, 70(1), 80-89.