Atrofia cognitiva organizacional: cuando la IA piensa por tu equipo

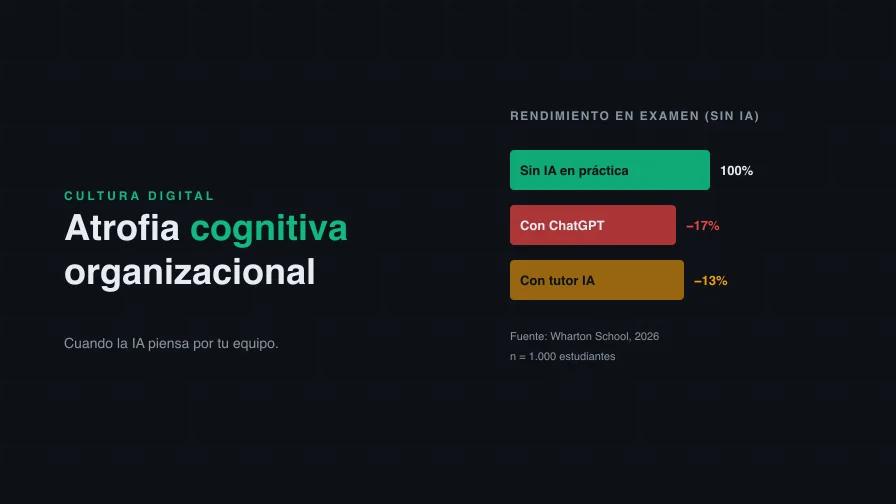

Un experimento de Wharton demostró que estudiantes con ChatGPT rindieron 17% peor en exámenes sin tecnología. El mismo fenómeno está ocurriendo en las organizaciones que adoptan IA sin estrategia de desarrollo de capacidades.

Un experimento reciente en la Escuela de Negocios de Wharton produjo un resultado que debería preocupar a cualquier líder organizacional que esté implementando herramientas de IA. Investigadores dieron acceso a ChatGPT a 1.000 estudiantes de secundaria durante sesiones de práctica de matemáticas. Los resultados durante la práctica fueron espectaculares: el grupo con IA básica resolvió más problemas, y el grupo con la versión “tutor” pulverizó las métricas de rendimiento. Luego llegó el examen final — sin tecnología permitida. Los estudiantes que practicaron con ChatGPT puntuaron un 17% peor que los que practicaron sin ninguna tecnología. Ni siquiera la versión tutor, diseñada específicamente para facilitar el aprendizaje, logró superar a los estudiantes que estudiaron solos.

Cuando los investigadores analizaron los logs de lo que los estudiantes escribían en el prompt, el patrón era revelador: la inmensa mayoría se limitaba a teclear “¿cuál es la respuesta?” La IA actuó como muleta. Los estudiantes externalizaron su pensamiento y confundieron la fluidez del modelo con su propia competencia. Y lo más grave: estaban convencidos de que usar ChatGPT no había perjudicado su aprendizaje. Estaban confiadamente equivocados.

Este fenómeno — la atrofia cognitiva por delegación — no se limita al aula. Está ocurriendo en las organizaciones que adoptan herramientas de IA sin una estrategia deliberada de desarrollo de capacidades.

La paradoja de la productividad aparente

Carr (2014), en “The Glass Cage: Automation and Us,” documentó lo que llamó el “paradoja de la automatización”: cuanto más confiable es un sistema automatizado, menos preparadas están las personas para intervenir cuando el sistema falla. Los pilotos que dependen del piloto automático pierden habilidades de vuelo manual. Los médicos que dependen de sistemas de diagnóstico por IA pierden capacidad diagnóstica independiente. Los analistas que dependen de dashboards automatizados pierden la capacidad de interrogar los datos por su cuenta.

En el contexto organizacional, la paradoja se manifiesta de formas específicas. Un equipo de marketing que usa IA generativa para producir contenido puede multiplicar su output — pero si el equipo nunca desarrolló criterio editorial propio, la IA amplifica mediocridad a velocidad industrial. Un equipo de análisis que usa copilots para escribir código puede entregar más rápido — pero si los analistas no entienden la lógica del código que la IA genera, cada línea es deuda técnica invisible. Un equipo directivo que usa IA para resumir reportes puede procesar más información — pero si los directivos no leen los reportes originales, pierden el contexto y los matices que hacen que la información sea útil para la toma de decisiones.

Parasuraman y Manzey (2010), en su revisión sobre “complacencia por automatización,” demostraron que las personas tienden a confiar excesivamente en sistemas automatizados incluso cuando tienen evidencia de que el sistema está produciendo errores. Este sesgo — llamado automation bias — es particularmente pronunciado cuando la automatización es fluida y presenta resultados con alta confianza aparente, que es exactamente lo que hacen los modelos de lenguaje grande.

Delegar la ejecución genera productividad. Delegar el pensamiento garantiza irrelevancia.

La distinción clave no es si usar IA o no — es qué se delega. Hay una diferencia fundamental entre delegar tareas de ejecución (formatear un documento, generar variantes de un diseño, estructurar datos tabulares) y delegar tareas de pensamiento (diagnosticar un problema, evaluar alternativas, formular una estrategia). La primera categoría libera tiempo cognitivo para actividades de mayor valor. La segunda categoría atrofia la capacidad de la organización para generar ese valor.

El problema es que la línea entre ambas categorías es borrosa, y la presión por productividad empuja sistemáticamente hacia la delegación total. Cuando un gerente le pide a ChatGPT que “analice” los resultados de la encuesta de clima y genere recomendaciones, está delegando pensamiento — no ejecución. Cuando un equipo de estrategia le pide a un modelo que “identifique oportunidades de mercado” basado en datos internos, está delegando juicio — no procesamiento. Estas delegaciones producen output que parece valioso pero que no pasó por el filtro del conocimiento contextual, la experiencia acumulada y el juicio experto que la organización supuestamente está pagando por tener.

Davenport y Kirby (2016), en “Only Humans Need Apply,” argumentaron que la ventaja competitiva sostenible en la era de la automatización no reside en hacer cosas más rápido sino en hacer cosas que las máquinas no pueden hacer: formular problemas (no solo resolverlos), integrar conocimiento de múltiples dominios, ejercer juicio ético, y crear significado. Estas capacidades solo se desarrollan con práctica deliberada — exactamente lo que la delegación prematura a la IA impide.

Lo que observamos en las organizaciones

En nuestra práctica de consultoría vemos un patrón recurrente. Las organizaciones que adoptan herramientas de IA sin estrategia de capacidades experimentan tres fases:

Fase 1: Euforia de productividad (meses 1-3). Los equipos producen más, más rápido. Los reportes son más pulidos. Las presentaciones tienen mejor estructura. La percepción interna es uniformemente positiva.

Fase 2: Erosión silenciosa (meses 4-9). Los colaboradores más junior dejan de desarrollar habilidades fundamentales porque la IA las compensa. La calidad del output parece estable pero la capacidad de diagnosticar errores disminuye. Cuando la IA produce algo incorrecto — y lo hace regularmente — nadie lo detecta porque nadie tiene ya el criterio independiente para evaluarlo.

Fase 3: Dependencia estructural (mes 10+). La organización no puede operar sin las herramientas. No porque las herramientas sean indispensables sino porque las personas perdieron la capacidad de hacer el trabajo sin ellas. Esto crea una vulnerabilidad operacional que no aparece en ningún dashboard: la organización es más frágil de lo que era antes de adoptar la IA, aunque produce más.

El estudio de Wharton validó empíricamente lo que la teoría de la automatización predice desde hace décadas y lo que estamos observando en las organizaciones: la productividad aparente durante el uso asistido no predice la capacidad real cuando la asistencia no está disponible. Y la asistencia eventualmente no estará disponible — sea por fallo técnico, cambio de proveedor, restricción regulatoria, o simplemente porque el problema específico que hay que resolver no es del tipo que la IA puede asistir.

Cómo implementar IA sin atrofiar capacidades

La solución no es no usar IA — es usarla con una estrategia explícita de desarrollo de capacidades. Esto implica tres prácticas que rara vez vemos implementadas:

Primero, definir explícitamente qué se delega y qué no. Crear una taxonomía organizacional de tareas que distingue entre ejecución delegable (la IA lo hace y el humano verifica) y pensamiento no delegable (el humano lo hace y opcionalmente usa la IA para validar). Esta taxonomía debería ser específica por rol y actualizarse conforme las capacidades del equipo evolucionan.

Segundo, mantener ejercicios de práctica sin asistencia. Así como los pilotos mantienen horas de vuelo manual obligatorias, las organizaciones deberían mantener momentos deliberados de trabajo sin IA — no por nostalgia sino por desarrollo de capacidades. Un equipo de análisis que periódicamente escribe código sin copilot desarrolla comprensión que el equipo que siempre usa copilot pierde gradualmente.

Tercero, medir capacidad, no solo output. El output asistido por IA mide la capacidad del sistema humano + IA. Pero la resiliencia organizacional depende de la capacidad del humano solo. Incluir evaluaciones periódicas de capacidad independiente — qué puede hacer el equipo sin las herramientas — es una métrica de salud organizacional que ningún cuadro de mando incluye hoy pero debería.

La IA es una herramienta extraordinaria para amplificar capacidades existentes. Pero amplificar una capacidad que no se ha desarrollado no produce capacidad — produce dependencia. Y la dependencia, en un entorno competitivo donde las herramientas están disponibles para todos, no es una ventaja. La ventaja es la capacidad humana que la herramienta amplifica. Y esa capacidad solo se desarrolla con esfuerzo deliberado — exactamente el tipo de esfuerzo que la IA hace tan tentador evitar.

Referencias

- Carr, N. (2014). The Glass Cage: Automation and Us. W.W. Norton & Company.

- Davenport, T. H., & Kirby, J. (2016). Only Humans Need Apply: Winners and Losers in the Age of Smart Machines. Harper Business.

- Parasuraman, R., & Manzey, D. H. (2010). Complacency and bias in human use of automation. Human Factors, 52(3), 381-410.