Seniority en la era IA: cuando preguntar "por qué" vale más que escribir código perfecto

El profesional senior ya no se define por dominar sintaxis o frameworks. En la era de los copilotos, el seniority se mide por pensamiento crítico — la capacidad de preguntarle repetidamente "por qué" a la IA hasta llegar al fondo del problema.

Imaginemos dos versiones de un mismo profesional de tecnología. En 2020, su día comienza revisando un pull request donde un desarrollador junior confundió la complejidad algorítmica de una búsqueda. Dedica cuarenta minutos a explicar por qué un HashMap resuelve el problema en O(1) mientras que la implementación actual lo hace en O(n). Después, pasa dos horas diseñando la arquitectura de un microservicio que debe manejar picos de tráfico. Almuerza leyendo documentación de un framework que acaba de lanzar su versión 3.0. Por la tarde, resuelve un bug que lleva tres días abierto porque requiere entender cómo interactúan tres capas del sistema que nadie más domina. Su valor para la organización es claro: sabe cosas que otros no saben, ve patrones que otros no ven, y puede construir desde cero lo que otros no pueden.

Avancemos seis años. Es 2026 y el mismo profesional abre su día de manera diferente. Está trabajando con un copiloto de IA que genera código funcional en segundos. El pull request del junior ya no tiene errores de complejidad algorítmica porque el copiloto los previno durante la escritura. La arquitectura del microservicio ya no se diseña desde una pizarra en blanco: el profesional describe los requisitos de negocio y la IA genera tres propuestas arquitectónicas con trade-offs documentados. El bug de tres capas lo diagnostica en veinte minutos porque le pide al modelo que trace las interacciones entre componentes. Pero aquí viene lo que importa: su valor no desapareció. Se transformó. Ahora dedica su tiempo a preguntar por qué la IA eligió esa arquitectura y no otra, a cuestionar si el problema que están resolviendo es realmente el problema correcto, a evaluar si la solución técnicamente elegante es organizacionalmente viable dado el equipo que la va a mantener. Las habilidades que lo hacían senior cambiaron. No desaparecieron — mutaron.

Esta transformación no es una especulación futurista. Es lo que observamos en las organizaciones que ya operan con copilotos de IA integrados en sus flujos de trabajo. Y plantea una pregunta que las empresas de tecnología, pero también las consultoras, los bancos, las firmas legales y cualquier organización con profesionales del conocimiento, necesitan responder: si la IA puede hacer lo que antes solo podía hacer un senior, entonces qué es ser senior ahora.

La definición tradicional de seniority: años + conocimiento técnico

Durante décadas, la industria del conocimiento definió el seniority mediante una fórmula implícita: años de experiencia multiplicados por amplitud técnica. Un desarrollador senior tenía ocho o más años escribiendo código, dominaba varios lenguajes, podía diseñar sistemas complejos desde cero y había acumulado suficientes cicatrices de producción para anticipar problemas antes de que ocurrieran. Un consultor senior conocía los frameworks de mejora de procesos, había liderado implementaciones en múltiples industrias y podía navegar la política organizacional con la misma fluidez con la que navegaba un modelo de madurez. Un analista senior manejaba técnicas estadísticas avanzadas, entendía las limitaciones de los datos y sabía presentar resultados a audiencias que no distinguen entre correlación y causalidad.

Esta definición tenía sentido cuando esas capacidades eran escasas y costosas de desarrollar. Aprender a programar requería años de práctica deliberada. Dominar un framework de consultoría requería docenas de proyectos. Desarrollar intuición sobre datos requería exponerse a suficientes datasets para reconocer patrones anómalos sin necesidad de análisis formal. La escasez de estas habilidades justificaba la prima salarial y el estatus organizacional del senior.

El mecanismo de acumulación de seniority era fundamentalmente lineal: más tiempo en la disciplina producía más conocimiento, más conocimiento producía mejor juicio, mejor juicio producía más valor. Las organizaciones calibraron sus escalas de carrera, sus procesos de evaluación y sus modelos de compensación alrededor de esta premisa. El título de “senior” era, en esencia, un certificado de acumulación: esta persona ha acumulado suficiente conocimiento para que confíes en su criterio sin necesidad de verificarlo constantemente.

Pero esa premisa tenía una vulnerabilidad que no era evidente mientras el conocimiento técnico fuera el recurso escaso: confundía el saber hacer con el saber pensar. Muchos profesionales clasificados como seniors eran extraordinariamente competentes en la ejecución pero no necesariamente superiores en el juicio. Podían construir sistemas robustos pero no siempre cuestionaban si el sistema era la solución correcta. Podían implementar un proceso de mejora continua pero no siempre evaluaban si la mejora que perseguían era la que la organización necesitaba. La distinción no era visible porque, cuando el cuello de botella es la ejecución, quien ejecuta mejor es quien más valor aporta.

Lo que la IA commoditizó — y lo que no puede

La inteligencia artificial generativa hizo algo que ninguna herramienta anterior había logrado: commoditizó la ejecución técnica de nivel intermedio. No la eliminó; la commoditizó. Escribir código funcional, generar análisis de datos, producir documentos estructurados, diseñar arquitecturas estándar — todas estas actividades que antes requerían años de práctica ahora pueden ser realizadas por un profesional con acceso a un copiloto de IA y la capacidad de articular lo que necesita. El resultado es que la brecha de ejecución entre un junior con IA y un senior sin IA se ha reducido dramáticamente para tareas rutinarias.

Pero hay una asimetría fundamental en lo que la IA puede y no puede hacer, y en esa asimetría se encuentra la nueva definición de seniority. La IA puede generar respuestas. No puede generar las preguntas correctas. Puede optimizar una solución dentro de los parámetros que recibe. No puede cuestionar si los parámetros son los correctos. Puede producir código que pasa todos los tests. No puede evaluar si los tests están probando lo que realmente importa para el negocio. Puede analizar datos y encontrar patrones. No puede determinar si esos patrones son relevantes para la decisión que la organización enfrenta.

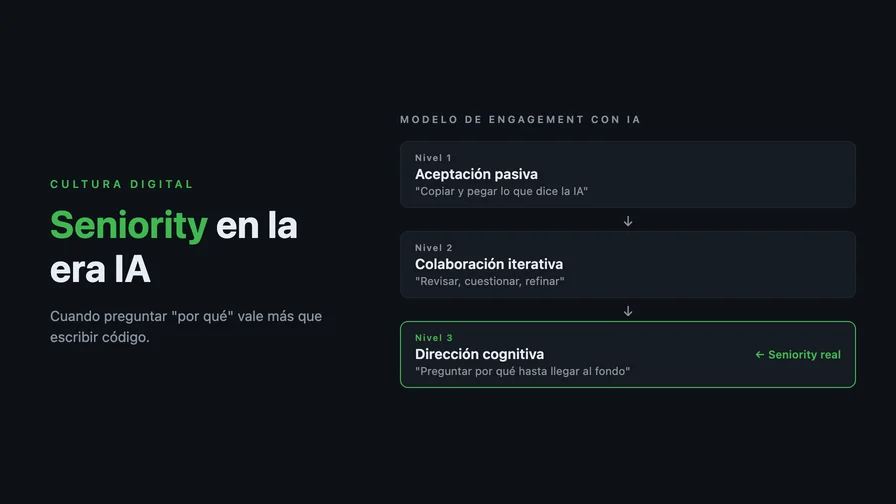

An (2025), en un paper fundamental sobre la interacción humano-IA, propone un modelo de tres niveles de engagement con la inteligencia artificial. El primer nivel es la aceptación pasiva: el usuario recibe el output de la IA y lo utiliza sin cuestionamiento. El segundo nivel es la colaboración iterativa: el usuario refina los outputs mediante intercambios sucesivos, mejorando progresivamente la calidad del resultado. El tercer nivel es la dirección cognitiva: el usuario aplica expertise de dominio y habilidades metacognitivas para dirigir la IA hacia outputs que ni el usuario ni la IA habrían producido por separado. An argumenta que la transición entre niveles no requiere entrenamiento técnico en IA sino desarrollo de expertise de dominio y capacidad de juicio evaluativo. La mayoría de los usuarios profesionales opera en el nivel uno. El seniority genuino en la era de la IA reside en operar consistentemente en el nivel tres.

Esta observación tiene implicaciones profundas para cómo las organizaciones definen, evalúan y desarrollan a sus profesionales senior. Si el valor ya no está en la ejecución sino en la dirección — en saber qué preguntar, no en saber qué escribir — entonces los criterios de seniority necesitan recalibrarse. Y no se trata de un ajuste menor. Es un cambio de paradigma comparable a la transición de la manufactura artesanal a la industrial: el artesano que dominaba todas las etapas del proceso fue reemplazado no por un operario más eficiente sino por un diseñador que entendía qué producto construir y por qué.

Leça y Santos (2025) llegaron a una conclusión convergente desde un ángulo diferente. En su estudio sobre las competencias requeridas para profesionales que trabajan en proyectos con IA, identificaron que las habilidades blandas que diferencian a los profesionales efectivos no son las que tradicionalmente aparecen en las descripciones de cargo. No es “comunicación” en abstracto ni “trabajo en equipo” como platitud corporativa. Son capacidades específicas: curiosidad para explorar posibilidades que la IA no sugiere espontáneamente, pensamiento crítico para evaluar outputs antes de actuar sobre ellos, empatía para entender cómo las soluciones técnicas afectan a las personas que las van a usar, y responsabilidad ética para considerar las consecuencias de implementar lo que la IA recomienda. Estas capacidades no se desarrollan escribiendo más código. Se desarrollan enfrentando problemas ambiguos con consecuencias reales.

El método socrático aplicado a la IA

Existe una técnica que sintetiza en una práctica concreta lo que An describe como “dirección cognitiva” y lo que Leça y Santos identifican como “curiosidad y pensamiento crítico.” Consiste en aplicar el método socrático — la práctica de preguntar repetidamente “por qué” — a la interacción con la inteligencia artificial.

La mecánica es sencilla pero sus efectos son profundos. Cuando un profesional le pide a la IA una solución y acepta la primera respuesta, está operando en el nivel uno de An: aceptación pasiva. Cuando recibe la respuesta y pregunta “por qué elegiste este enfoque y no otro,” activa un mecanismo doble. Por un lado, fuerza a la IA a explicitar su razonamiento, lo cual frecuentemente expone suposiciones implícitas, razonamientos circulares o información inventada — las llamadas alucinaciones. Por otro lado, el profesional que pregunta desarrolla comprensión genuina del dominio del problema, porque cada “por qué” lo obliga a procesar la respuesta, evaluarla contra su conocimiento previo y formular una pregunta más precisa.

Sun et al. (2026) estudiaron empíricamente esta dinámica en un contexto educativo de programación, comparando dos enfoques de interacción con IA generativa. Un grupo utilizaba la IA para obtener respuestas directas — el equivalente del nivel uno de An. El otro grupo utilizaba un marco de preguntas socráticas donde la IA, en lugar de dar soluciones, guiaba al usuario mediante preguntas. Los resultados fueron contundentes: el grupo socrático desarrolló prácticas reflexivas e iterativas — depuración, cuestionamiento, uso analítico de herramientas — mientras que el grupo de respuesta directa priorizó correcciones rápidas mediante ensayo y error, generando una dependencia superficial del código generado por la IA. Además, las actitudes del grupo socrático se mantuvieron positivas a lo largo del tiempo gracias a que las preguntas estructuradas alineaban las expectativas y reducían la carga cognitiva, mientras que las del grupo directo declinaron por la frustración de expectativas no cumplidas.

El “bucle del por qué” funciona como un mecanismo simultáneo de control de calidad y de aprendizaje. Cada iteración produce dos resultados: una respuesta más precisa de la IA y una comprensión más profunda en el humano. Después de tres o cuatro rondas de “por qué,” el profesional típicamente llega a una de dos conclusiones: o entiende genuinamente el problema y puede evaluar la solución con criterio propio, o descubre que la IA estaba fabricando una cadena de razonamientos plausibles pero incorrectos. Ambas conclusiones son valiosas. La primera construye expertise real. La segunda previene errores costosos.

Este mecanismo es particularmente relevante para el fenómeno de las alucinaciones en modelos de lenguaje. Las alucinaciones no siempre son obvias. Un modelo puede generar una explicación técnica que suena perfectamente razonable, utiliza terminología correcta y sigue una estructura lógica, pero que contiene una premisa fabricada que invalida toda la cadena de razonamiento. La aceptación pasiva no detecta estas alucinaciones porque la señal superficial — coherencia lingüística — sugiere corrección. El cuestionamiento socrático las detecta porque cada “por qué” obliga al modelo a profundizar en un razonamiento que, si está fabricado, eventualmente se contradice o se queda sin sustento.

Gerlich (2025) documentó este riesgo con datos preocupantes. Su estudio encontró una correlación negativa significativa entre el uso frecuente de herramientas de IA y las habilidades de pensamiento crítico, mediada por un aumento en la descarga cognitiva. En términos simples: cuanto más delegan las personas su pensamiento a la IA sin cuestionarla, menos capaces se vuelven de pensar críticamente por cuenta propia. El efecto es particularmente pronunciado en profesionales jóvenes que están formando sus habilidades cognitivas fundamentales. La paradoja es que la herramienta diseñada para amplificar la capacidad cognitiva puede atrofiarla si se usa sin el filtro del cuestionamiento deliberado.

Del senior que sabe al senior que pregunta

La transición del seniority basado en conocimiento al seniority basado en cuestionamiento es cognitivamente clara pero emocionalmente compleja. Los profesionales senior construyeron su identidad profesional — y frecuentemente su autoestima — sobre la base de saber cosas que otros no saben. Ser la persona que tiene la respuesta es un rol cómodo y socialmente reforzado. Las organizaciones premian a quien resuelve problemas rápidamente, no a quien hace preguntas que complican la conversación.

Ahora se les pide que redefinan su valor. Que pasen de “yo sé la respuesta” a “yo sé cuáles son las preguntas correctas.” Que abandonen la comodidad del expertise acumulado y adopten la vulnerabilidad de la indagación permanente. Que admitan que la IA puede escribir mejor código, generar mejores análisis iniciales y producir mejores primeros borradores que ellos — y que eso no los hace menos valiosos, sino que redefine dónde reside su valor.

Esta transición requiere lo que los psicólogos llaman humildad intelectual: la capacidad de reconocer los límites del propio conocimiento sin que eso amenace la identidad profesional. Y requiere una mentalidad de crecimiento que permita ver la incertidumbre como oportunidad de aprendizaje en lugar de amenaza al estatus. Ambas son capacidades que las organizaciones rara vez desarrollan deliberadamente en sus profesionales técnicos.

Tabarsi et al. (2025) documentaron empíricamente esta transición en un estudio con dieciséis profesionales de software que adoptaron herramientas basadas en modelos de lenguaje en las etapas tempranas de su disponibilidad. Los hallazgos son reveladores. Los desarrolladores reportaron ganancias sustanciales de productividad al reducir tareas rutinarias, pero describieron lo que los investigadores llamaron la “paradoja productividad-calidad”: frecuentemente descartaban el código generado y desplazaban su esfuerzo de escribir código a evaluarlo críticamente e integrarlo. El uso de modelos de lenguaje era altamente dependiente de la fase del proyecto, con una adopción fuerte en implementación y depuración pero influencia limitada en levantamiento de requisitos y trabajo colaborativo.

Lo más significativo del estudio de Tabarsi et al. es que los desarrolladores que más valor extrajeron de las herramientas no fueron los que las usaron más frecuentemente sino los que desarrollaron nuevas competencias para usarlas efectivamente. Estas competencias incluían estrategias de ingeniería de prompts, verificación en capas — múltiples rondas de validación del output antes de aceptarlo — e integración segura para proteger datos propietarios. Anticiparon cambios en las expectativas de contratación, en las prácticas de equipo y en la educación en ingeniería de software, pero enfatizaron que el juicio humano y las habilidades fundamentales de ingeniería de software siguen siendo esenciales. En otras palabras: la herramienta no reemplaza al profesional; redefine qué tipo de profesional necesita ser.

Lee et al. (2025) aportaron evidencia complementaria desde una muestra más amplia. Su estudio con 319 trabajadores del conocimiento reveló un hallazgo que debería preocupar a cualquier organización: la mayor confianza en la IA generativa se asocia con menos pensamiento crítico, mientras que la mayor autoconfianza del profesional se asocia con más pensamiento crítico. Esto sugiere que el antídoto contra la atrofia cognitiva no es la desconfianza en la IA sino la confianza en la propia capacidad de evaluar sus outputs. El profesional senior que sabe que puede pensar independientemente utiliza la IA como amplificador. El profesional que no confía en su propio juicio la utiliza como muleta — y en el proceso, deteriora aún más el juicio que necesita para usarla bien.

Pensamiento crítico como diferencial competitivo

En un mundo donde todas las organizaciones tienen acceso a los mismos modelos de IA, con las mismas capacidades y las mismas limitaciones, el diferenciador competitivo no puede ser la herramienta. El diferenciador es la calidad del juicio humano que se aplica sobre el output de la herramienta. Dos organizaciones que usan el mismo copiloto de IA para desarrollar software producirán resultados radicalmente diferentes si una tiene profesionales que aceptan el código generado y otra tiene profesionales que lo cuestionan, lo evalúan contra el contexto de negocio y lo refinan iterativamente.

Esta asimetría tiene implicaciones directas para la estrategia de talento. Las organizaciones que siguen contratando y promoviendo exclusivamente por conocimiento técnico acumulado están invirtiendo en un activo que se deprecia aceleradamente. Las que contratan y promueven por capacidad de cuestionamiento, juicio contextual y pensamiento sistémico están invirtiendo en un activo que se aprecia a medida que la IA se vuelve más capaz — porque cuanto más potente es la herramienta, más valioso es el criterio para dirigirla.

Nazir y Arif (2026) sistematizaron esta preocupación en un marco que debería ser lectura obligatoria para líderes de tecnología. Su análisis de los trade-offs cognitivos asociados con la dependencia sostenida de la IA generativa propone un modelo híbrido de tres fases para la integración equilibrada: Detectar (exploración asistida por IA), Involucrar (resolución manual de problemas y razonamiento algorítmico) y Verificar (refinamiento asistido por IA). El modelo cambia el énfasis de la automatización total a un proceso orientado al aprendizaje que prioriza la exploración, el razonamiento humano y la evaluación crítica. Su argumento central es que las organizaciones necesitan alinear el uso de herramientas de IA con objetivos pedagógicos — no solo productivos — para asegurar que el sistema promueva comprensión profunda y no simplemente generación de output.

Esto no significa que las organizaciones deban frenar la adopción de IA. Significa que deben complementarla con desarrollo deliberado de pensamiento crítico. El error no es darle IA a los equipos. El error es darle IA a los equipos sin desarrollar simultáneamente su capacidad de cuestionar lo que la IA produce. Es como darle un bisturí láser a un cirujano sin asegurarse de que entiende anatomía: la herramienta es más precisa, pero el juicio sobre dónde cortar sigue siendo humano.

Kabashkin (2025) formalizó este equilibrio con un modelo cuantitativo que propone un “índice de sostenibilidad cognitiva” que integra cinco parámetros conductuales: autonomía, reflexión, creatividad, delegación y dependencia. Su modelo identifica zonas cognitivas que van desde la atrofia hasta la sinergia. Cuando el índice cae por debajo del umbral de sostenibilidad — cuando hay demasiada delegación y poca reflexión — la automatización reemplaza el razonamiento humano en lugar de amplificarlo. La implicación para las organizaciones es que la productividad inmediata que genera la IA puede estar creando un déficit cognitivo que se manifiesta como incapacidad para resolver problemas cuando la IA falla, cuando el problema es nuevo o cuando el contexto requiere juicio que no está en los datos de entrenamiento.

Las organizaciones deberían evaluar y recompensar la capacidad de cuestionamiento con la misma rigurosidad con la que evalúan la capacidad de ejecución. Esto implica cambios concretos: en las entrevistas de contratación, preguntar no solo cómo resolvería un problema sino qué preguntas haría antes de resolverlo. En las evaluaciones de desempeño, valorar no solo cuántos tickets cerró sino cuántos problemas mal planteados identificó antes de que se convirtieran en tickets. En las promociones, considerar no solo la profundidad técnica sino la amplitud de juicio contextual.

Cómo desarrollar pensamiento crítico en equipos técnicos

Si el pensamiento crítico es el nuevo diferenciador de seniority, las organizaciones necesitan formas concretas de desarrollarlo. No basta con declarar que “valoramos el pensamiento crítico” en la página de valores corporativos. Se necesitan prácticas estructuradas que lo conviertan en un hábito organizacional.

La primera práctica es transformar las revisiones de código de una evaluación de calidad técnica a una evaluación de adecuación contextual. La pregunta estándar en un code review es “funciona correctamente?” La pregunta que desarrolla pensamiento crítico es “por qué este enfoque y no otro?” Cuando un desarrollador presenta una solución y el revisor pregunta sistemáticamente por qué eligió esa arquitectura, ese patrón, esa librería, obliga al autor a articular su razonamiento — y en el proceso, frecuentemente descubre que parte de ese razonamiento fue delegado a la IA sin evaluación propia. La revisión se convierte en un espacio de aprendizaje donde lo que se evalúa no es solo el artefacto sino el proceso de pensamiento que lo produjo.

La segunda práctica es instituir períodos deliberados de trabajo sin IA. Esto puede sonar contraintuitivo en una organización que busca productividad, pero la evidencia sobre atrofia cognitiva lo respalda. Así como un atleta que usa exoesqueleto necesita sesiones sin él para mantener su musculatura, un profesional que usa copilotos de IA necesita períodos donde resuelve problemas con su propio criterio para mantener su capacidad de juicio independiente. Estos períodos no deben ser punitivos ni nostálgicos — “los verdaderos programadores no necesitan IA” — sino deliberados y estratégicos: mantener afilada la herramienta cognitiva que permite evaluar lo que la IA produce. El estudio de Gerlich (2025) respalda esta práctica: la correlación negativa entre uso de IA y pensamiento crítico sugiere que la práctica independiente funciona como un contrapeso necesario.

La tercera práctica son las sesiones de cuestionamiento de output de IA. El formato es simple: un equipo toma una solución generada por IA — un diseño arquitectónico, un análisis de datos, una propuesta de proceso — y dedica una hora a cuestionarla sistemáticamente. No para descartarla sino para entenderla. Qué suposiciones está haciendo. Qué información no tiene. Qué contexto organizacional no puede considerar. Qué podría salir mal si se implementa tal cual. Estas sesiones desarrollan simultáneamente la capacidad de evaluación crítica y el conocimiento contextual del negocio — las dos competencias que, según la investigación, distinguen al profesional que opera en el nivel tres de An del que permanece en el nivel uno.

La cuarta práctica es el mentoring inverso en interacción con IA. Los profesionales más jóvenes frecuentemente son más fluidos en el uso de herramientas de IA pero menos capaces de evaluar críticamente sus outputs. Los profesionales más experimentados tienen mejor criterio de evaluación pero pueden ser menos hábiles en la interacción con la IA. El mentoring inverso, donde un junior enseña al senior a usar la herramienta mientras el senior enseña al junior a cuestionar sus resultados, crea un intercambio de capacidades complementarias que desarrolla pensamiento crítico en ambas direcciones.

La quinta práctica es documentar las decisiones humanas que la IA no puede tomar. En cada proyecto, las decisiones que involucran juicio contextual — por qué se priorizó este requisito sobre otro, por qué se eligió esta tecnología dado el equipo disponible, por qué se aceptó un trade-off técnico por razones organizacionales — deben documentarse explícitamente como decisiones humanas. Esta documentación hace visible el valor del juicio que la IA no puede replicar y crea un corpus de conocimiento organizacional que es genuinamente diferenciador.

Otten et al. (2026), en un estudio con 51 profesionales de la industria del software, identificaron que la IA generativa crea demanda de nuevas habilidades — como la evaluación de output y la ingeniería de prompts — al mismo tiempo que fortalece la importancia de competencias blandas como la resolución de problemas y el pensamiento crítico, y de competencias tradicionales como el diseño arquitectónico y la depuración. Sus recomendaciones para la academia son directamente trasladables a las organizaciones: incorporar la IA en los flujos de trabajo pero rediseñar los mecanismos de evaluación para que midan comprensión profunda, no solo producción de artefactos.

El profesional senior del futuro

El profesional senior del futuro no es el que más sabe. Es el que mejor pregunta. No es el que puede construir un sistema desde cero sin ayuda — porque esa habilidad, aunque impresionante, es cada vez menos relevante cuando un copiloto de IA puede generar la primera versión en minutos. Es el que puede mirar esa primera versión y preguntar: es esto lo que necesitamos construir? Estamos resolviendo el problema correcto? Esta solución es viable dado nuestro contexto organizacional, nuestro equipo, nuestras restricciones regulatorias, nuestros usuarios?

El cambio es profundo porque no es solo técnico — es identitario. Requiere que profesionales que construyeron carreras sobre la base de tener respuestas reconstruyan su identidad profesional sobre la base de tener preguntas. Requiere que organizaciones que premiaron la velocidad de ejecución empiecen a premiar la profundidad de cuestionamiento. Requiere que la industria reconozca que el pensamiento crítico no es una habilidad blanda complementaria sino la habilidad dura central de la era de la IA.

Muorwel Matueny y Juma Nyamai (2025) describen con precisión el riesgo de no hacer esta transición: la “ilusión de competencia” — una percepción engañosa de dominio creada por outputs generados por IA que enmascaran déficits cognitivos subyacentes. Cuando un profesional genera consistentemente outputs de alta calidad con ayuda de IA sin desarrollar la capacidad de producirlos o evaluarlos independientemente, la organización tiene un riesgo oculto: el día que la IA falla, que el problema es genuinamente nuevo, o que el contexto requiere juicio que no está en los datos de entrenamiento, ese profesional no puede responder. La ilusión de competencia se rompe en el peor momento posible.

La respuesta no es rechazar la IA ni romantizar el pasado en que los seniors lo hacían todo manualmente. La respuesta es reconocer que la IA amplifica lo que el humano aporta — y asegurarse de que lo que el humano aporta sea juicio, no solo instrucciones. Como argumenta An (2025), la IA funciona como un amplificador cognitivo: magnifica las capacidades existentes del usuario. Si el usuario aporta expertise de dominio, criterio evaluativo y pensamiento crítico, la IA amplifica esos atributos y produce resultados extraordinarios. Si el usuario aporta instrucciones superficiales y aceptación pasiva, la IA amplifica esa superficialidad y produce resultados que parecen buenos pero no lo son.

El seniority en la era de la inteligencia artificial no se mide por lo que sabes. Se mide por la calidad de lo que preguntas. Y la organización que entienda esto primero — que invierta en desarrollar cuestionadores profesionales y no solo ejecutores eficientes — tendrá una ventaja competitiva que ningún modelo de lenguaje puede replicar. Porque los modelos generan respuestas. Las preguntas correctas siguen siendo, y probablemente seguirán siendo por mucho tiempo, irreductiblemente humanas.

Referencias

- An, T. (2025). AI as Cognitive Amplifier: Rethinking Human Judgment in the Age of Generative AI. ArXiv, 2512.10961.

- Gerlich, M. (2025). AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking. Societies, 15(1), 6. DOI: 10.3390/soc15010006

- Kabashkin, I. (2025). Cognitive Atrophy Paradox of AI-Human Interaction: From Cognitive Growth and Atrophy to Balance. Information, 16(11), 1009. DOI: 10.3390/info16111009

- Leça, M. de M., & Santos, R. de S. (2025). Curious, Critical Thinker, Empathetic, and Ethically Responsible: Essential Soft Skills for Data Scientists in Software Engineering. ICSE-SEIS 2025. DOI: 10.1109/ICSE-SEIS66351.2025.00021

- Lee, H., Sarkar, A., Tankelevitch, L., Drosos, I., Rintel, S., Banks, R., & Wilson, N. (2025). The Impact of Generative AI on Critical Thinking: Self-Reported Reductions in Cognitive Effort and Confidence Effects From a Survey of Knowledge Workers. CHI 2025. DOI: 10.1145/3706598.3713778

- Muorwel Matueny, R., & Juma Nyamai, J. (2025). Illusion of Competence and Skill Degradation in Artificial Intelligence Dependency among Users. IJRSI, 12(5). DOI: 10.51244/ijrsi.2025.120500163

- Nazir, M., & Arif, Y. (2026). Is AI Code Generation Undermining Developers’ Problem-Solving Skills? Journal of Software Engineering. DOI: 10.62762/jse.2025.847963

- Otten, D., Stalnaker, T., Wintersgill, N., Chaparro, O., Poshyvanyk, D., & Schmidt, D. C. (2026). “Don’t Be Afraid, Just Learn”: Insights from Industry Practitioners to Prepare Software Engineers in the Age of Generative AI. ArXiv, 2604.06342.

- Sun, D., Zheng, Y., Xu, J., & Yang, Z. (2026). When Generative AI Meets Socratic Method: Investigating Programming Learning Dynamics Through Behaviours, Interaction Qualities and Perceptions. Journal of Computer Assisted Learning. DOI: 10.1002/jcal.70210

- Tabarsi, B. T., Reichert, H., Limke, A., Kuttal, S., & Barnes, T. (2025). LLMs’ Reshaping of People, Processes, Products, and Society in Software Development: A Comprehensive Exploration with Early Adopters. ArXiv, 2503.05012. DOI: 10.48550/arXiv.2503.05012