IA en capacitación corporativa: la trampa de la productividad aparente

Las organizaciones están integrando IA en sus programas de formación midiendo velocidad de completación en lugar de transferencia de aprendizaje. Los datos muestran que la eficiencia aparente puede estar comprando incompetencia real.

La promesa es atractiva: integrar herramientas de inteligencia artificial en los programas de capacitación corporativa para “personalizar el aprendizaje,” “acelerar el onboarding” y “aumentar la retención de conocimiento.” Los proveedores de plataformas de aprendizaje reportan cifras impresionantes: 40% menos tiempo de completación, 60% más módulos terminados, satisfacción del participante por encima del 90%. Las métricas son reales. Lo que no es real es la conclusión que se extrae de ellas.

Un estudio en la Escuela de Negocios de Wharton puso números a lo que la teoría del aprendizaje predice desde hace décadas: estudiantes que usaron ChatGPT durante su práctica completaron más ejercicios y reportaron mayor satisfacción con su experiencia de aprendizaje. En el examen sin asistencia tecnológica, rindieron 17% peor que los que practicaron sin ninguna herramienta. La versión “tutor” de la IA — diseñada específicamente para facilitar aprendizaje, no para dar respuestas directas — tampoco logró superar al grupo control. Los investigadores analizaron los logs y encontraron el patrón: la inmensa mayoría de los estudiantes usaba la IA para obtener la respuesta, no para aprender el proceso.

Este resultado no es una anécdota — es la manifestación empírica de un principio bien establecido en ciencia del aprendizaje: la dificultad deseable.

Dificultad deseable: el principio que la IA viola

Bjork (1994) introdujo el concepto de “desirable difficulties” — condiciones de aprendizaje que hacen la práctica más difícil a corto plazo pero que producen retención y transferencia superiores a largo plazo. El espaciamiento (practicar con intervalos en lugar de en bloque), la intercalación (mezclar tipos de problemas en lugar de agruparlos), la recuperación activa (recordar sin consultar la fuente), y la generación (producir respuestas antes de recibirlas) son todas dificultades deseables respaldadas por décadas de investigación.

La IA generativa, por diseño, elimina estas dificultades. Cuando un colaborador en un programa de capacitación puede pedirle a una herramienta de IA que le explique el concepto, le muestre un ejemplo, le resuelva el ejercicio y le corrija el resultado, todas las dificultades deseables desaparecen. El aprendizaje se siente fluido — pero la fluidez percibida (processing fluency) no es un indicador confiable de aprendizaje real. Koriat (1997), en su investigación sobre metacognición, demostró que las personas consistentemente confunden facilidad de procesamiento con calidad de comprensión. Lo que se siente fácil se percibe como aprendido — aunque no lo esté.

El problema específico de la capacitación corporativa

En el contexto corporativo, este problema tiene dimensiones adicionales que no existen en el aula universitaria:

Las métricas de aprendizaje miden completación, no competencia. La mayoría de los sistemas de gestión de aprendizaje (LMS) miden cuántos módulos completó el colaborador, cuánto tiempo tardó, y qué calificación obtuvo en los quizzes. Con asistencia de IA, estas métricas se ven espectaculares: alta completación, tiempos reducidos, calificaciones perfectas. Pero ninguna de estas métricas captura la pregunta relevante: ¿el colaborador puede hacer en el trabajo lo que el programa supuestamente le enseñó?

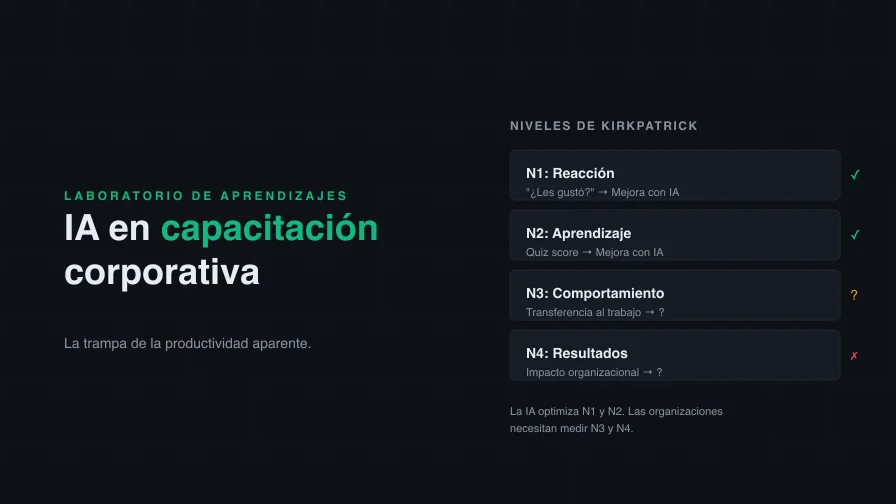

Kirkpatrick (1959) propuso un modelo de cuatro niveles para evaluar la formación: reacción (¿les gustó?), aprendizaje (¿adquirieron conocimiento?), comportamiento (¿cambió su desempeño en el trabajo?) y resultados (¿impactó métricas organizacionales?). La mayoría de la capacitación corporativa se evalúa en nivel 1 — reacción — y ocasionalmente en nivel 2 — aprendizaje medido por quiz. Los niveles 3 y 4, que son los que realmente importan, se miden raramente. La IA mejora dramáticamente las métricas de nivel 1 y 2 sin evidencia de que mejore — y con evidencia de que puede empeorar — los niveles 3 y 4.

La presión por eficiencia compite con la eficacia del aprendizaje. Las áreas de capacitación en las organizaciones operan bajo presión constante por “hacer más con menos”: más personas capacitadas, menos horas por programa, menos costo por participante. La IA parece la solución perfecta para esta ecuación. Pero la ecuación es falsa — porque la eficiencia de la capacitación no es una función de cuántas personas completan cuántos módulos en cuánto tiempo, sino de cuántas personas desarrollan capacidades que usan en su trabajo para producir resultados medibles.

El conocimiento tácito no se captura en módulos. Polanyi (1966) distinguió entre conocimiento explícito (codificable, transmisible por texto) y conocimiento tácito (implícito, adquirido por práctica). La mayor parte del conocimiento valioso en una organización es tácito: cómo negociar con un cliente difícil, cómo interpretar una anomalía en los datos, cómo manejar una conversación difícil con un colaborador. Este tipo de conocimiento se adquiere por experiencia guiada, feedback directo y reflexión sobre la práctica — ninguno de los cuales puede reemplazarse con un chatbot de capacitación, por sofisticado que sea.

Lo que vemos en las organizaciones

En nuestra práctica observamos un patrón preocupante: las organizaciones que integran IA en sus programas de formación reportan mejoras en todas las métricas convencionales de capacitación — y simultáneamente reportan que “la capacitación no se transfiere al trabajo.” Estas dos observaciones no son contradictorias — son consistentes. Las métricas convencionales no miden transferencia, y la IA optimiza exactamente lo que las métricas miden: completación, velocidad y satisfacción superficial.

El resultado es un ciclo perverso: la capacitación se ve mejor que nunca en los reportes, los colaboradores completan más programas que nunca, y las áreas operativas siguen quejándose de que “la gente no sabe lo que debería saber.” La respuesta organizacional típica es más capacitación — más módulos, más contenido, más horas en la plataforma — lo cual agrava el problema porque más del mismo tipo de capacitación produce más del mismo tipo de resultado: completación sin competencia.

Cómo diseñar capacitación que funcione con IA

La solución no es eliminar la IA de la capacitación sino rediseñar la capacitación para que la IA cumpla un rol que no interfiera con el aprendizaje:

La IA como generadora de escenarios, no como tutora. En lugar de que la IA responda preguntas del participante (lo cual elimina la dificultad deseable de la recuperación activa), usar la IA para generar escenarios de práctica variados e impredecibles — lo cual aumenta la dificultad deseable de la intercalación. Un programa de capacitación en negociación donde la IA genera contrapartes con diferentes perfiles, objeciones y estilos obliga al participante a practicar en condiciones variables — que es exactamente lo que la transferencia al trabajo real requiere.

Evaluación de competencia sin asistencia. Separar explícitamente los momentos de práctica asistida (donde la IA puede aportar) de los momentos de evaluación no asistida (donde se mide lo que el participante puede hacer solo). Esta separación es exactamente lo que el estudio de Wharton midió: rendimiento con IA versus rendimiento sin IA. Las organizaciones deberían hacer lo mismo — no porque desconfíen de la IA sino porque necesitan saber la capacidad real de su gente.

Métricas de transferencia, no de completación. Reemplazar “módulos completados” y “horas de formación” con métricas que capturen cambio de comportamiento en el trabajo: ¿el vendedor que tomó el programa de negociación cerró más deals? ¿El gerente que completó el programa de liderazgo tiene mejor retención en su equipo? ¿El analista que fue capacitado en SQL puede extraer datos sin pedir ayuda? Estas métricas son más difíciles de medir — pero son las únicas que importan.

Espaciamiento y recuperación obligatoria. Diseñar los programas con intervalos de práctica sin asistencia — sesiones donde el participante debe recordar y aplicar sin consultar la IA. Esto se siente más difícil y los participantes reportarán menor satisfacción. Pero la satisfacción del participante no predice aprendizaje — la dificultad percibida sí.

La capacitación corporativa tiene un problema de métricas — mide lo que es fácil de medir en lugar de lo que importa medir. La IA amplifica este problema porque optimiza espectacularmente las métricas fáciles. La organización que quiere formación que funcione necesita tener el coraje de medir lo difícil: no cuántas personas completaron el programa, sino cuántas personas pueden hacer algo que no podían hacer antes. Y esa medición, por definición, no puede hacerse con asistencia.

Referencias

- Bjork, R. A. (1994). Memory and metamemory considerations in the training of human beings. En J. Metcalfe & A. Shimamura (Eds.), Metacognition: Knowing about Knowing (pp. 185-205). MIT Press.

- Kirkpatrick, D. L. (1959). Techniques for evaluating training programs. Journal of the American Society of Training Directors, 13, 3-26.

- Koriat, A. (1997). Monitoring one’s own knowledge during study: A cue-utilization approach to judgments of learning. Journal of Experimental Psychology: General, 126(4), 349-370.

- Polanyi, M. (1966). The Tacit Dimension. University of Chicago Press.