La economía de la inferencia: por qué la IA no escala como el software tradicional

Entrenar un modelo es un costo único. Servirlo a millones de usuarios es otra historia. La ecuación de rentabilidad de la IA sigue siendo una incógnita que las organizaciones necesitan entender antes de apostar su estrategia digital.

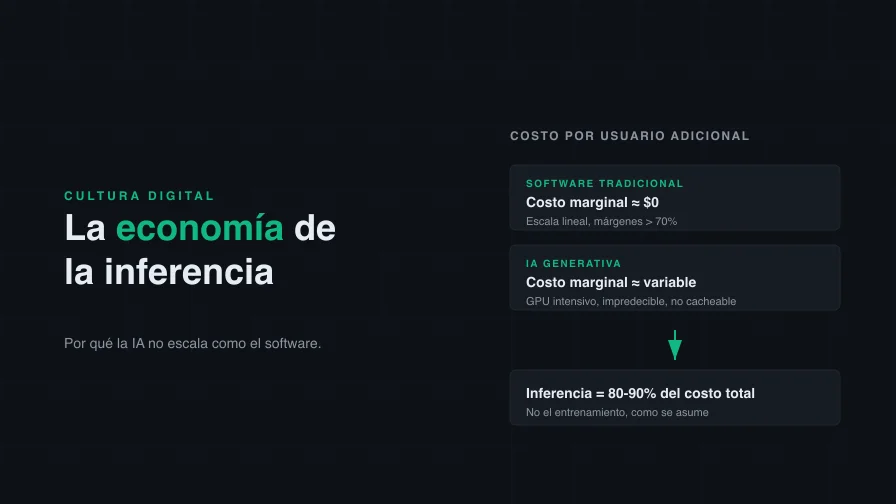

La industria de la inteligencia artificial opera bajo una asimetría económica que pocas organizaciones entienden y que tiene implicaciones directas para cualquier estrategia de adopción tecnológica. La asimetría es esta: entrenar un modelo de lenguaje grande es extraordinariamente caro — cientos de millones de dólares en cómputo — pero es un costo único. Servir ese modelo a millones de usuarios es un costo recurrente, intensivo en recursos, impredecible y difícil de escalar. Atender a 1.000 usuarios cuesta proporcionalmente mucho más que atender a uno.

Esto contradice la lógica económica que hizo del software tradicional uno de los negocios más rentables de la historia. En el software convencional, los costos marginales de escala son casi despreciables: una vez desarrollado, servir a un usuario adicional cuesta fracciones de centavo en almacenamiento y ancho de banda. Es la economía que hizo posible que empresas como Microsoft, Google o Salesforce alcanzaran márgenes brutos superiores al 70%. Cada nuevo usuario era prácticamente ganancia pura.

La IA generativa rompe este modelo. Cada consulta a un modelo grande requiere cómputo en tiempo real — inferencia — que consume GPU, memoria y energía. A diferencia de servir una página web o procesar una transacción en base de datos, la inferencia no se optimiza con las mismas técnicas que optimizaron el software tradicional. Los caches funcionan peor porque cada consulta es distinta. El procesamiento por lotes es limitado porque los usuarios esperan respuestas en tiempo real. Y el hardware especializado (GPUs, TPUs) es caro y tiene disponibilidad restringida.

Las señales del mercado

Las decisiones recientes de las empresas líderes en IA reflejan esta realidad económica. Anthropic reduce los tiempos de respuesta pero cobra diferencialmente por modelo y por volumen. OpenAI cierra productos que requieren inferencia intensiva — como su aplicación de generación de video — porque el costo de servir esos productos a escala no es sostenible con los precios actuales. Las empresas que ofrecen IA “ilimitada” lo hacen con restricciones implícitas: throttling, colas de espera, modelos más pequeños en horas pico.

Estas no son decisiones técnicas — son decisiones económicas que revelan que el problema de la inferencia eficiente no está resuelto. Y mientras no se resuelva, la ecuación de rentabilidad de la IA sigue siendo, para muchos casos de uso, una incógnita.

Amodei (2025) señaló que el costo de la inferencia se reduce aproximadamente un orden de magnitud cada 18 meses — una curva prometedora pero que parte de una base extraordinariamente alta. Patterson et al. (2021), en su análisis de la huella de carbono del machine learning, documentaron que la inferencia representa entre el 80% y el 90% del cómputo total del ciclo de vida de un modelo desplegado — no el entrenamiento, como comúnmente se asume. Este dato redefine dónde están los costos reales de la IA en producción.

Implicaciones para la estrategia organizacional

Para una organización que está evaluando cómo integrar IA en sus operaciones, estas dinámicas tienen implicaciones concretas que pocas consultoras discuten:

La IA como servicio tiene costos variables, no fijos. A diferencia del software empresarial tradicional (donde pagas una licencia por usuario y el costo es predecible), el costo de los servicios de IA generativa depende del volumen de uso, la complejidad de las consultas y el modelo utilizado. Una organización que integra IA en procesos de alto volumen — atención al cliente, análisis de documentos, generación de contenido — puede encontrar que los costos escalan de formas que el presupuesto original no contemplaba. La planificación financiera de la adopción de IA requiere modelos de costo variable, no fijo.

La dependencia de proveedor es más profunda que con software tradicional. Con software convencional, migrar de un proveedor a otro es costoso pero conceptualmente simple: los datos se exportan, el nuevo sistema se configura, y los usuarios se reentrenan. Con IA generativa, la migración implica que los prompts optimizados para un modelo pueden no funcionar en otro, que los flujos de trabajo construidos alrededor de las capacidades específicas de un modelo deben recalibrarse, y que la calidad del output puede variar significativamente entre proveedores. Esto crea un lock-in más sutil pero más profundo que el lock-in de software tradicional.

La ventaja competitiva no está en la herramienta sino en la aplicación. Si el costo de inferencia hace inviable que los proveedores ofrezcan IA ilimitada a bajo costo, entonces la ventaja no está en tener acceso a la IA (que todos tendrán) sino en saber aplicarla de formas que generen valor específico para la organización. Esto requiere capacidades internas — comprensión del negocio, datos propietarios, criterio sobre qué automatizar y qué no — que son exactamente las capacidades que la externalización total de la IA no desarrolla.

El problema de la escalabilidad para empresas latinoamericanas

En mercados como Panamá y Centroamérica, la economía de la inferencia tiene una dimensión adicional: la infraestructura. Los centros de datos con GPUs de última generación están concentrados en Norteamérica y Europa. La latencia de servir modelos desde Virginia o Frankfurt a usuarios en Ciudad de Panamá o San José es medible y afecta la experiencia de uso. Los costos de ancho de banda para transmitir datos a modelos alojados en otros continentes se suman a los costos de inferencia.

Para organizaciones que procesan información sensible — datos financieros, registros de salud, información legal — la ubicación del procesamiento no es solo una cuestión de latencia sino de regulación. Los marcos regulatorios de protección de datos en la región están evolucionando, y la pregunta de “dónde se procesan los datos que envías a un modelo de IA” es una pregunta de cumplimiento que pocas organizaciones están haciendo.

Qué hacer con esta información

La recomendación no es evitar la IA — es adoptar la IA con una comprensión realista de su economía. Tres principios prácticos:

Primero, presupuestar la IA como costo variable. Proyectar el costo de IA como si fuera una licencia de software fija es un error que produce sorpresas presupuestarias. Establecer pilotos controlados que permitan medir el costo real por caso de uso antes de escalar es una práctica de gestión financiera que aplica a cualquier tecnología con costos variables, y la IA es una de ellas.

Segundo, diversificar proveedores deliberadamente. No construir toda la estrategia de IA sobre un solo proveedor. Mantener la capacidad de alternar entre modelos según el caso de uso — un modelo más económico para tareas simples, uno más potente para tareas complejas — es una estrategia que optimiza costos y reduce dependencia. Esto requiere una capa de abstracción que pocas organizaciones construyen pero que paga dividendos operacionales.

Tercero, invertir en capacidades internas. Los datos propietarios, el conocimiento del contexto organizacional y la capacidad de formular las preguntas correctas son activos que no dependen de la economía de la inferencia. Un equipo que sabe qué preguntar y cómo evaluar las respuestas genera valor con cualquier modelo — caro o barato, local o remoto, actual o futuro. Invertir en estas capacidades es una apuesta que no se deprecia con el próximo ciclo de precios de los proveedores de IA.

El que resuelva el problema de inferencia eficiente no solo ganará dinero — redefinirá quién sobrevive en esta industria. Pero mientras ese problema se resuelve, las organizaciones que adoptan IA con los ojos abiertos — entendiendo sus costos reales, sus limitaciones de escala y su dependencia de infraestructura — estarán mejor posicionadas que las que asumen que la IA es simplemente “software que piensa” y que escala como cualquier otro software. No lo es, y no lo hace.

Referencias

- Patterson, D., Gonzalez, J., Le, Q., et al. (2021). Carbon emissions and large neural network training. arXiv preprint arXiv:2104.10350.

- Varian, H. R. (2018). Artificial intelligence, economics, and industrial organization. NBER Working Paper No. 24839.