Gobernanza de IA: el vacío que las organizaciones llenan mal

Solo el 5% de organizaciones en Panamá tiene gobernanza formal de IA. Qué debería contener un marco mínimo viable y por qué los frameworks existentes no se implementan.

La inteligencia artificial está siendo implementada en organizaciones panameñas y centroamericanas sin un marco que defina quién es responsable cuando algo sale mal. Esta no es una afirmación alarmista sino un dato: el estudio de Elemente (2025) sobre madurez de IA en Panamá encontró que solo el 5% de las organizaciones encuestadas tiene un marco formal de gobernanza de IA. El 95% restante opera en uno de dos estados: ausencia total de reglas (la IA se usa como cada persona o área decide) o aplicación ad hoc de marcos existentes que no fueron diseñados para los riesgos específicos de esta tecnología.

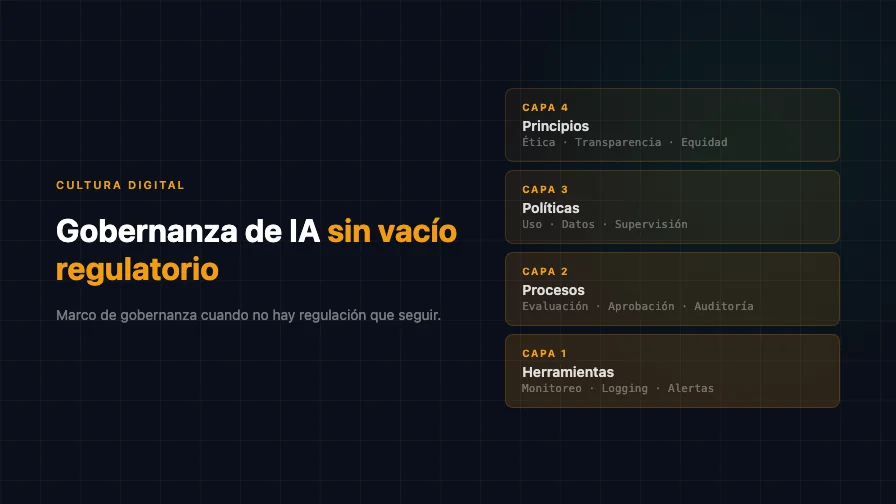

El concepto de gobernanza de IA abarca un territorio amplio, y esa amplitud es parte del problema. Cuando una organización escucha “gobernanza de IA,” puede imaginarse un comité de ética que debate los dilemas filosóficos de la inteligencia artificial, o una política de 50 páginas que nadie lee, o un proceso de aprobación que retrasa cualquier iniciativa de IA hasta hacerla inviable. Ninguna de estas interpretaciones es útil. La gobernanza de IA operativa — la que produce valor — responde a preguntas concretas: ¿quién autoriza el uso de IA para un caso de uso específico? ¿Qué criterios se aplican para decidir si un caso de uso es apropiado? ¿Cómo se valida que el sistema de IA funciona correctamente antes y después de ponerlo en producción? ¿Quién es responsable cuando el sistema produce un resultado incorrecto que afecta a un cliente o a una decisión de negocio?

La Unión Europea, con el AI Act (2024), estableció un marco basado en riesgo: los sistemas de IA se clasifican según el nivel de riesgo que representan (inaceptable, alto, limitado, mínimo) y cada nivel tiene obligaciones proporcionales. Los sistemas de alto riesgo — que incluyen aplicaciones en servicios financieros, seguros y gestión de recursos humanos — deben cumplir requisitos de transparencia, documentación, supervisión humana y gestión de calidad de datos. Este marco no es directamente aplicable en Panamá (no hay legislación equivalente), pero ofrece una estructura conceptual que las organizaciones pueden adaptar: no todos los usos de IA merecen el mismo nivel de gobernanza, y la gobernanza proporcional al riesgo es más implementable que la gobernanza uniforme.

NIST (2023), con el AI Risk Management Framework, propuso un enfoque complementario organizado en cuatro funciones: Govern (establecer la estructura de decisión), Map (identificar y categorizar los riesgos), Measure (evaluar los riesgos identificados), y Manage (implementar controles y respuestas). El framework es técnicamente robusto pero extenso — demasiado extenso para una organización de 300 personas que está empezando a usar IA. La pregunta operativa es cómo reducir estos marcos comprehensivos a un conjunto mínimo viable de reglas que produzcan gobernanza funcional sin paralizar la adopción.

Un marco mínimo viable de gobernanza de IA para una organización de servicios regulados en la región necesita resolver cinco cosas. Primera: un inventario de usos de IA — qué herramientas de IA se están usando, en qué procesos, por quién, con qué datos. La mayoría de las organizaciones no saben cuántos empleados están usando ChatGPT, Copilot o Gemini en su trabajo diario, ni qué tipo de información están ingresando en esas herramientas. El inventario no requiere tecnología sofisticada; requiere una política que defina qué se puede usar y un mecanismo de registro cuando se introduce una nueva herramienta o caso de uso.

Segunda: una clasificación de riesgo por caso de uso. Un chatbot que responde preguntas frecuentes sobre horarios de atención tiene un perfil de riesgo radicalmente diferente al de un modelo que informa decisiones de crédito. Tratar ambos con el mismo nivel de gobernanza es ineficiente — el chatbot se sobrecontrola y la decisión de crédito se subcontrola. La clasificación puede ser simple: riesgo bajo (la IA asiste pero un humano decide), riesgo medio (la IA informa una decisión significativa), riesgo alto (la IA toma o influye decisiones con impacto regulatorio, financiero o sobre personas).

Tercera: reglas de datos — qué datos pueden alimentar sistemas de IA y bajo qué condiciones. Los datos de clientes identificables no deberían enviarse a APIs externas sin evaluación de cumplimiento. Los documentos regulatorios pueden procesarse pero las respuestas deben validarse antes de usarse para decisiones de cumplimiento. Los datos de empleados (evaluaciones de desempeño, datos de clima) no deberían procesarse por IA sin consentimiento y propósito definido. Estas reglas no son complejas pero deben estar escritas y comunicadas.

Cuarta: responsabilidades claras. ¿Quién aprueba un nuevo caso de uso de IA? ¿Quién valida que funciona correctamente? ¿Quién responde cuando no funciona? En la mayoría de las organizaciones, las respuestas son: nadie formalmente, nadie sistemáticamente, y el equipo de TI por default. Esta distribución de responsabilidades — o más precisamente, esta ausencia de distribución — es lo que produce el estado actual donde la IA se implementa sin supervisión.

Quinta: un mecanismo de revisión periódica. Los sistemas de IA no son estáticos: los datos cambian, los modelos se actualizan, el regulador emite nuevas circulares, los patrones de uso evolucionan. Un marco de gobernanza que se define una vez y se archiva es tan inútil como no tener marco. La cadencia de revisión — trimestral para casos de alto riesgo, semestral para el resto — debe estar definida, con responsable y formato.

La resistencia a la gobernanza de IA proviene frecuentemente de los equipos más entusiastas con la tecnología, que perciben cualquier marco de reglas como burocracia que frena la innovación. Esta percepción es comprensible pero equivocada. La gobernanza bien diseñada no frena la innovación — la hace sostenible. Una organización que implementa IA sin gobernanza y experimenta un incidente — datos de clientes expuestos, una decisión de crédito incorrecta basada en un modelo sesgado, una respuesta regulatoria generada por IA que contiene información falsa — va a reaccionar con restricciones excesivas que sí frenen la innovación por años. La gobernanza preventiva es siempre menos costosa que la gobernanza reactiva.

En el contexto centroamericano, donde la regulación específica de IA no existe o es incipiente, las organizaciones tienen una ventana para establecer prácticas de gobernanza proactivamente — antes de que el regulador las imponga. Las organizaciones que lleguen a la regulación con marcos ya implementados tendrán una ventaja competitiva significativa sobre las que deban construirlos bajo presión. Esta ventana no es indefinida: la velocidad con la que la IA se integra en procesos de negocio significa que los riesgos se acumulan con cada mes sin gobernanza, y el costo de remediación crece con cada implementación no gobernada que se pone en producción.

La gobernanza de IA no es un proyecto de tecnología. Es un proyecto de organización que requiere participación de negocio, cumplimiento, legal, tecnología y recursos humanos. Las organizaciones que lo delegan exclusivamente a TI terminan con controles técnicos sin contexto de negocio; las que lo delegan a cumplimiento terminan con políticas sin implementación técnica. La intersección — donde el conocimiento técnico se encuentra con el contexto regulatorio y las necesidades de negocio — es donde se diseña gobernanza que funciona. Y esa intersección, en la mayoría de las organizaciones, no tiene dueño. Darle uno es el primer paso.

Referencias

- Elemente. (2025). Nivel de Madurez del Uso de la Inteligencia Artificial en Panamá. Noviembre 2025.

- European Union. (2024). Regulation (EU) 2024/1689 laying down harmonised rules on artificial intelligence (AI Act).

- NIST. (2023). AI Risk Management Framework (AI RMF 1.0). National Institute of Standards and Technology.