La Deuda Técnica que Nadie en el C-Suite Quiere Ver

El problema de calidad de datos en las organizaciones latinoamericanas no es técnico. Es político. Los datos están fragmentados porque los silos organizacionales son funcionales antes que tecnológicos.

Expertos en implementación de IA convergieron en 2026 en un diagnóstico incómodo: la calidad de los datos importa más que la elección del modelo. No importa qué tan avanzado sea el algoritmo si los datos que lo alimentan son inconsistentes, incompletos o no reflejan la realidad operativa de la organización. Gartner proyectó que las organizaciones abandonarán el 60% de los proyectos de IA que no cuenten con datos en condiciones adecuadas para su uso. Y Gartner además documentó que el 27% de los datos en las corporaciones más grandes del mundo son erróneos.

Estos números tienen una implicación directa: antes de evaluar qué modelo de IA adoptar, la pregunta relevante es si la organización tiene datos que valga la pena modelar.

Esa pregunta incomoda porque la respuesta honesta, en la mayoría de las organizaciones medianas de la región, es que no. Y la razón no es tecnológica.

La naturaleza política de los silos de datos

El 68% de los profesionales de gestión de datos identifican los silos como su principal desafío, según la encuesta anual de DATAVERSITY. La cifra aumentó 7 puntos porcentuales entre 2023 y 2024. Aumenta mientras la inversión en plataformas de datos también aumenta. Ese es el síntoma del problema de fondo: no se puede resolver un problema organizacional con una solución tecnológica.

Los silos de datos no son una falla técnica. Son el reflejo en la capa de datos de cómo está organizado el poder dentro de la empresa.

En una organización donde Finanzas y Comercial compiten por recursos o por visibilidad ejecutiva, cada área tiene incentivos para no compartir sus datos. El sistema de información de crédito no se integra con el CRM comercial no porque los sistemas sean incompatibles —aunque a veces también lo son— sino porque la gerencia de crédito tiene razones organizacionales para mantener control exclusivo sobre sus datos. Esa información es poder. La cede cuando el costo político de cederla es menor que el beneficio de la integración.

Un estudio de Salesforce cuantificó el impacto operativo de esa fragmentación: las organizaciones con silos de datos pierden en promedio 7,8 millones de dólares anuales en productividad perdida. Los empleados dedican 12 horas semanales buscando información entre sistemas desconectados. El tiempo de resolución de casos de clientes aumenta un 43% cuando los agentes no tienen una vista unificada.

Estos números son globales y representan promedios de grandes organizaciones. En empresas medianas de la región, la magnitud absoluta es menor, pero la proporción del impacto sobre la capacidad operativa suele ser similar o mayor.

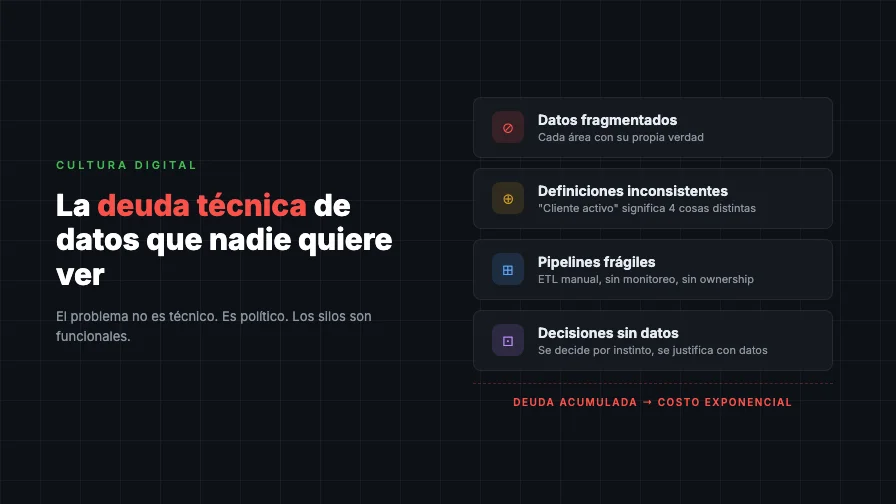

Las capas de la deuda de datos

La deuda de datos —análoga a la deuda técnica en software— es la acumulación de decisiones subóptimas en gestión de información que se tomaron priorizando la velocidad o la conveniencia sobre la calidad y la consistencia. Tiene al menos tres capas que operan simultáneamente.

La capa técnica: sistemas legacy y duplicación

La primera capa es visible y relativamente fácil de diagnosticar, aunque costosa de resolver. Incluye sistemas heredados que no se comunican entre sí, tablas de datos duplicadas con criterios de actualización distintos, formatos inconsistentes entre áreas, y procesos de extracción manual que introducen errores en cada ciclo.

Gartner documentó que las organizaciones administran en promedio 897 aplicaciones, pero solo el 29% de ellas están integradas entre sí. Cada sistema desconectado es un silo potencial. La integración no es un proyecto de datos; es un proyecto de arquitectura empresarial que requiere decisiones sobre cuáles sistemas son el registro maestro de qué información y quién tiene la autoridad para tomar esa decisión.

La capa organizacional: ownership sin accountability

La segunda capa es menos visible pero más determinante. Incluye la ausencia de definiciones acordadas entre áreas —el “cliente activo” de Comercial no es el mismo que el de Finanzas—, la inexistencia de procesos claros para resolver discrepancias, y la ausencia de roles con autoridad real sobre la calidad de los datos que su área produce.

El 54% de las organizaciones citan la calidad e integridad de los datos como su principal problema, según datos de electroiq. Pero “problema de calidad de datos” es una descripción técnica de lo que en realidad es un problema de accountability. Los datos tienen baja calidad porque nadie tiene consecuencias cuando la calidad es baja. El proceso que genera datos incorrectos continúa porque cambiarlo requiere la autorización de alguien que tiene otras prioridades, o porque la corrección expone errores que alguien preferiría no visibilizar.

La capa cultural: datos como poder, no como activo colectivo

La tercera capa es la más difícil de abordar. Es la cultura en la que los datos son un activo del departamento, no de la organización. Esta cultura no se declara; se practica. Se practica cuando una gerencia tarda semanas en responder una solicitud de datos de otra área. Se practica cuando un directivo prefiere presentar su propia hoja de cálculo antes que usar el reporte corporativo porque “sus números son más confiables”. Se practica cuando el acceso a los datos de un proceso es considerado un privilegio que se otorga o se niega según la relación política entre áreas.

Forrester documentó que entre el 60% y el 73% de los datos que las organizaciones recopilan nunca se usa para ningún propósito estratégico. Una parte de esa cifra corresponde a datos que efectivamente no son útiles. Pero otra parte corresponde a datos que existen, que son relevantes, y que simplemente no son accesibles para quienes podrían usarlos para mejorar decisiones.

Lo que la IA hace visible

La razón por la que la calidad de datos se convirtió en conversación ejecutiva en 2026, después de décadas siendo un problema técnico relegado a los equipos de TI, es que la IA la hizo visible de una manera que antes no era posible.

Cuando una organización implementa un modelo predictivo y el modelo produce resultados absurdos, la causa generalmente no es el algoritmo. Es los datos. El modelo hace visible, de forma inmediata y con impacto operativo concreto, lo que el equipo de datos llevaba años documentando en reportes que nadie leía.

IBM lo documentó con precisión: el 85% de los modelos de IA fallan por calidad de datos insuficiente o ausencia de datos relevantes. Gartner confirmó el patrón. La IA no creó el problema de datos; lo hizo caro e imposible de ignorar.

Este es, en realidad, el aporte más valioso de la presión por adoptar IA en las organizaciones: no los modelos en sí, sino el diagnóstico forzado de la infraestructura de información. Las organizaciones que aprovechan ese momento —en lugar de buscar formas de rodear el problema de datos para avanzar con el piloto— tienen una oportunidad de resolver una deuda que tiene consecuencias en toda la operación, no solo en el proyecto de IA.

Por qué el C-suite no quiere ver este problema

La deuda de datos es invisible en los estados financieros. No aparece como un pasivo en el balance general. No genera alertas en los sistemas de control de gestión. Su costo es difuso: decisiones subóptimas, oportunidades no identificadas, tiempo operativo perdido. Difícil de cuantificar, fácil de ignorar cuando hay otras presiones más visibles.

Hay también un problema de autoría. Reconocer que los datos de la organización son de baja calidad implica reconocer que los procesos que los generan son deficientes, que los controles que deberían asegurar su calidad no funcionan, y que las decisiones que se tomaron basadas en esos datos merecen revisión. Eso toca egos, responsabilidades y posiciones.

En un contexto donde la velocidad de la agenda ejecutiva es alta y los proyectos de largo plazo compiten con las urgencias del trimestre, resolver la deuda de datos requiere un tipo de voluntad organizacional que es escasa: la capacidad de invertir tiempo y recursos en una mejora que no tiene fecha de entrega ni hito visible, pero que habilita prácticamente todo lo demás.

Aplicación práctica: por dónde empezar sin paralizarse

La deuda de datos no se resuelve de una vez. Se resuelve en capas, con priorización estratégica.

El primer paso no es tecnológico. Es identificar los tres o cuatro dominios de datos que más impactan las decisiones de negocio más importantes de la organización. Clientes, crédito, operaciones, inventario —depende del sector. Esos son los dominios donde la inversión en calidad tiene el retorno más claro y donde la fricción política de resolver el ownership es más justificable.

El segundo paso es nombrar a alguien —con nombre y apellido, no “el equipo de datos”— como responsable de la calidad de cada dominio prioritario, con autoridad para hacer preguntas incómodas sobre los procesos que generan los datos y para escalar cuando la respuesta es “así siempre se ha hecho”.

El tercer paso es medir. No la calidad de todos los datos —eso es un proyecto de varios años— sino la calidad de los datos en los dominios prioritarios, con métricas simples y visibilidad ejecutiva. Lo que no se mide no mejora, y lo que no tiene visibilidad ejecutiva no recibe los recursos que necesita.

Ninguno de estos pasos requiere una plataforma de datos nueva. Requieren decisiones organizacionales que la mayoría de las organizaciones han postergado porque son incómodas.

Conclusión

La deuda de datos no es un problema técnico que los equipos de TI resolverán cuando tengan tiempo y presupuesto. Es un problema organizacional que requiere decisiones ejecutivas sobre poder, accountability y prioridades. La IA la hizo urgente. Pero su resolución depende de la misma voluntad organizacional que siempre fue necesaria para cualquier transformación real.

Las organizaciones que resuelven su deuda de datos no lo hacen porque compraron la plataforma correcta. Lo hacen porque un líder con mandato real decidió que eso era prioritario y lo sostuvo hasta que la calidad de los datos cambió la calidad de las decisiones.

Referencias

- Gartner. (2026). Citado en IBM Think: “Organizations will abandon 60% of AI projects unsupported by AI-ready data.”

- Gartner. Citado en LLCBuddy / electroiq: “27% of data in the world’s largest corporations is erroneous.”

- DATAVERSITY. (2024). Trends in Data Management Survey. Dato: 68% citan silos como principal desafío.

- electroiq. (2025). Data Governance Statistics and Facts. Dato: 54% citan calidad e integridad como principales problemas.

- Forrester Research. Dato sobre 60-73% de datos sin uso estratégico.

- Salesforce. Dato sobre $7.8M en productividad perdida y 12 horas semanales buscando información. Citado en Integrate.io (2026).

- IBM. (2025). Data Quality Issues. IBM Think. Dato: 85% de modelos de IA fallan por calidad de datos.

- MuleSoft. (2025). Connectivity Benchmark Report. Dato: organizaciones promedio con 897 aplicaciones, 29% integradas.

- Experian Data Quality. Citado en LLCBuddy: “Bad data costs the firm 12% of its revenue.”