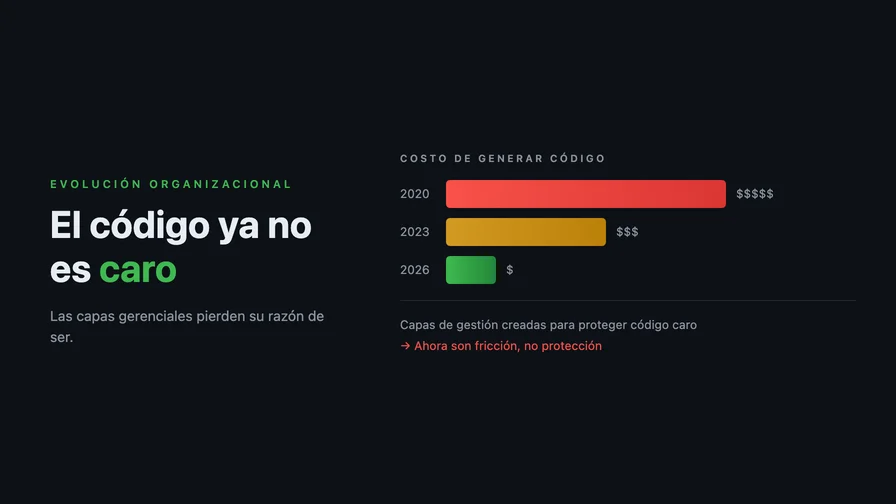

El código ya no es caro: por qué las capas gerenciales de software pierden su razón de ser

Durante décadas, el alto costo de escribir código justificó múltiples capas de gestión para evitar errores costosos. Con la IA, generar código es barato. Las capas que existían para proteger ese costo ya no aportan el mismo valor.

Imagina que manana el costo de escribir codigo se reduce a una decima parte de lo que costaba hace cinco anos. No el costo de pensarlo, no el costo de decidir que construir, sino el costo puro de producir lineas funcionales de software. Ahora preguntate: que le pasa a cada estructura organizacional que fue disenada bajo el supuesto de que escribir codigo es caro? Que le pasa al organigrama que justifica tres capas de gestion entre la idea de negocio y el primer commit? Que le pasa a los procesos de aprobacion, los comites de priorizacion, las ceremonias de grooming que existen, en el fondo, porque desperdiciar tiempo de un desarrollador era desperdiciar un recurso escaso y costoso?

Esto no es un ejercicio hipotetico. Esta ocurriendo ahora. Y la mayoria de las organizaciones de software no han procesado sus implicaciones porque el cambio no llego como una disrupcion visible — llego como una herramienta mas en el editor de codigo. Pero las herramientas que cambian la economia de produccion terminan cambiando las estructuras que esa economia creo. Y las estructuras gerenciales del desarrollo de software son, en gran medida, un producto de la economia del codigo caro.

La economia del codigo caro

Para entender por que las organizaciones de software se estructuraron como lo hicieron, hay que entender la economia que las origino.

Durante la mayor parte de la historia del desarrollo de software — desde los anos sesenta hasta la segunda decada del siglo veintiuno — escribir codigo era una actividad cara. Cara por multiples razones convergentes. Primero, los desarrolladores competentes eran escasos. Formar a un programador que pudiera producir software confiable requeria anos de educacion formal, anos adicionales de experiencia practica, y un proceso de seleccion que descartaba a la mayoria de los candidatos. La oferta de talento siempre estuvo por detras de la demanda, lo cual mantenia los salarios altos y la capacidad de produccion limitada.

Segundo, el proceso de escritura de codigo era laborioso. Cada linea tenia que ser pensada, escrita manualmente, compilada, depurada y probada. No habia autocompletado inteligente, no habia sugerencias contextuales, no habia generacion automatica de tests unitarios. El debugging era un proceso artesanal que podia consumir mas tiempo que la escritura original. Un bug sutil en produccion podia costar semanas de investigacion.

Tercero, el despliegue era riesgoso. Antes de la era del continuous deployment, poner codigo en produccion era un evento de alto estres que involucraba ventanas de mantenimiento, rollback plans, y a veces oraciones. Un error en produccion no se corregia con un hotfix en quince minutos — podia significar horas o dias de indisponibilidad, con impacto directo en ingresos y reputacion.

Cuarto, el retrabajo era devastador. Si se construia la funcionalidad incorrecta — porque los requisitos estaban mal definidos, porque el mercado cambio, porque el cliente no sabia lo que queria hasta que lo vio — el costo de reconstruir era casi equivalente al costo de haber construido desde cero. No habia forma rapida de iterar. Cada ciclo de construccion representaba una inversion significativa que la organizacion no podia permitirse desperdiciar.

Ante esta economia, las organizaciones respondieron de la unica forma racional posible: crearon sistemas para proteger la inversion. Cada capa gerencial, cada proceso de aprobacion, cada ceremonia de validacion surgio como respuesta logica a un entorno donde el error era caro y la capacidad de produccion era limitada. La burocracia del software no fue un accidente — fue una adaptacion.

Los gatekeepers: Product Managers, directores y la burocracia protectora

En una economia donde cada hora de desarrollo cuesta cientos de dolares y cada error puede costar miles, la funcion primaria de la gestion es evitar el desperdicio. Y asi se construyo la cadena de mando tipica de una organizacion de software.

El Product Manager existe para filtrar. Su trabajo fundamental es tomar un universo de posibles funcionalidades, priorizarlas segun valor de negocio, y asegurarse de que los desarrolladores trabajen solo en lo que importa. En un mundo donde el desarrollo es caro, esta funcion es critica: sin un PM, los desarrolladores podrian construir funcionalidades que nadie necesita, desperdiciando semanas de capacidad escasa. El PM no es un lujo — es un mecanismo de proteccion contra el desperdicio.

El Director de Ingenieria o VP de Ingenieria existe para coordinar y asignar. Con equipos de veinte, cincuenta, cien desarrolladores, alguien tiene que decidir quien trabaja en que, como se distribuyen los recursos entre proyectos, y como se resuelven los conflictos de prioridad cuando multiples stakeholders quieren el mismo recurso escaso. El director no solo gestiona personas — gestiona la asignacion de capital humano, que en una economia de codigo caro es el recurso mas valioso y limitado de la organizacion.

El arquitecto de software existe para prevenir el retrabajo. Su funcion es revisar las decisiones tecnicas antes de que se conviertan en codigo, identificar riesgos estructurales, y asegurarse de que la solucion propuesta no genere deuda tecnica que costara diez veces mas arreglar en el futuro. En un mundo donde reescribir es casi tan caro como escribir, el arquitecto es un seguro contra decisiones irreversibles.

Los procesos de aprobacion — sprint planning, grooming, design review, code review, QA sign-off, product sign-off — existen como puntos de control. Cada uno es una puerta que dice: “antes de gastar mas recursos en esto, confirmemos que vamos en la direccion correcta.” En un entorno donde cada paso es costoso, estos puntos de control tienen sentido economico. El costo de la ceremonia es menor que el costo de descubrir tarde que se construyo algo incorrecto.

Nada de esto fue irracional. Fue gestion de riesgo aplicada a una economia de escasez. Cada capa gerencial agregaba costo directo — salarios, tiempo en reuniones, latencia en decisiones — pero ese costo era menor que el costo del error que prevenian. La estructura se justificaba por la economia que la origino.

El problema es que la economia cambio.

Lo que cambio: el costo marginal de generar codigo se desplomo

En los ultimos tres anos, algo fundamental cambio en la economia del desarrollo de software: el costo marginal de generar codigo se desplomo. No desaparecio — pensar que construir buen software es ahora trivial seria un error grave — pero la fraccion del costo total que representaba la escritura mecanica de codigo se redujo de manera dramatica.

Los asistentes de programacion basados en inteligencia artificial — herramientas como GitHub Copilot, Cursor, Claude Code, y una lista creciente de alternativas — cambiaron la ecuacion de produccion. Un desarrollador senior que antes tardaba cuatro horas en escribir una funcion compleja con sus tests y documentacion ahora puede producir un primer borrador funcional en treinta minutos. No porque la IA escriba codigo perfecto — no lo hace — sino porque genera un punto de partida suficientemente bueno para que el humano lo revise, ajuste y refine en una fraccion del tiempo que le tomaria escribir desde cero.

Tabarsi et al. (2025), en un estudio cualitativo con desarrolladores profesionales que adoptaron herramientas basadas en modelos de lenguaje en sus flujos de trabajo, documentaron un cambio fundamental en la naturaleza del trabajo del programador: los desarrolladores reportaron ganancias sustanciales de productividad en tareas rutinarias, pero tambien describieron una “paradoja productividad-calidad” — frecuentemente descartaban el codigo generado y desplazaban su esfuerzo de escribir codigo a evaluarlo e integrarlo criticamente. El trabajo del desarrollador se transformo: paso de ser un escritor de codigo a ser un evaluador y curador de codigo. La habilidad critica ya no es la velocidad de tipeo ni el dominio enciclopedico de la sintaxis — es el juicio para distinguir codigo bueno de codigo mediocre, y la capacidad de articular con precision que se necesita construir.

Appanasamy (2025), en su analisis de la evolucion de la ingenieria de software en la era de la colaboracion con IA, lo articula de forma directa: los asistentes de programacion basados en IA demuestran mejoras medibles en la productividad de los desarrolladores y en la calidad del codigo a traves de diversos dominios de aplicacion. Los ingenieros se enfocan cada vez mas en actividades de alto valor, combinando experiencia en programacion tradicional con dominio de herramientas de IA. El paradigma que emerge no es uno donde el desarrollador desaparece — es uno donde el desarrollador se amplifica, produciendo en horas lo que antes requeria dias.

Pandey et al. (2024), en un estudio sobre GitHub Copilot en proyectos reales con bases de codigo propietarias, cuantificaron reducciones de hasta el 50% en tiempo dedicado a documentacion y autocompletado, y entre 30 y 40% en tareas repetitivas de codificacion, generacion de tests unitarios, debugging y programacion en pareja. Proyectaron una reduccion del 33 al 36% en el tiempo total dedicado a tareas de codificacion dentro de un ciclo de desarrollo cloud-first. Estas no son cifras marginales — representan una compresion significativa del ciclo de produccion.

Sankhe et al. (2025), en un experimento controlado con 120 desarrolladores profesionales, midieron un incremento del 31.4% en la productividad promedio al usar herramientas de generacion de codigo asistidas por IA. Notaron tambien un aumento del 23.7% en vulnerabilidades de seguridad en el codigo generado — lo cual refuerza que la IA no elimina la necesidad de juicio humano, sino que la reubica.

La implicacion economica de estos datos es profunda. Si un desarrollador individual puede producir el output que antes requeria un equipo de tres o cuatro, y si el ciclo de iteracion se comprime de semanas a horas, entonces toda la infraestructura organizacional que se construyo para gestionar la escasez y el riesgo del codigo caro esta operando sobre supuestos que ya no son validos.

Cuando la proteccion se convierte en friccion

Aqui es donde la logica organizacional empieza a invertirse. Las mismas capas que eran racionales en una economia de codigo caro se convierten en friccion en una economia de codigo barato.

Considera el flujo tipico para implementar una funcionalidad nueva en una organizacion de software de tamano medio. Un stakeholder identifica una necesidad. La comunica al Product Manager. El PM la evalua, la prioriza contra otras necesidades, la agrega al backlog. En la siguiente sesion de grooming, el equipo la discute, la descompone en historias de usuario, estima su complejidad. En el siguiente sprint planning, la historia se selecciona (o no). Un desarrollador la toma, la implementa, la sube a code review. El reviewer la revisa. QA la prueba. El PM valida que cumple los criterios de aceptacion. Se despliega.

Tiempo total desde la identificacion de la necesidad hasta la funcionalidad en produccion: tres a seis semanas, en un escenario optimista.

Ahora considera el mismo flujo con un equipo pequeno operando con herramientas de IA. Un miembro del equipo identifica una necesidad. La implementa en tres horas con asistencia de IA. La despliega a un entorno de prueba. La muestra a un usuario. Recibe feedback. Itera. En una semana, ha probado tres variantes de la solucion y tiene datos reales sobre cual funciona mejor.

La diferencia no es solo de velocidad — es de aprendizaje. En el primer modelo, la organizacion aprende algo nuevo cada tres a seis semanas. En el segundo, aprende algo nuevo cada dia. Y en mercados donde la velocidad de aprendizaje es la ventaja competitiva fundamental, esa diferencia es existencial.

Pero para que el segundo modelo funcione, no puede haber tres capas de aprobacion entre la idea y el experimento. Si experimentar cuesta casi nada — porque generar codigo es barato y desplegar a un entorno de prueba es trivial — entonces el costo de la aprobacion excede el costo del experimento. Estas gastando mas en decidir si vale la pena probar algo que lo que costaria simplemente probarlo.

Esta es la inversion fundamental: en una economia de codigo caro, el costo de equivocarse justifica el costo de prevenir. En una economia de codigo barato, el costo de prevenir excede el costo de equivocarse y corregir.

Las capas gerenciales que servian como proteccion se convierten en obstruccion. No porque las personas en esos roles sean incompetentes — sino porque la estructura fue disenada para una economia que ya no existe. Un PM que pasa dos semanas priorizando un backlog de funcionalidades que podrian construirse y probarse en ese mismo periodo no esta agregando valor — esta retrasando aprendizaje. Un comite de arquitectura que tarda un mes en aprobar un diseno que podria prototiparse en un dia no esta previniendo riesgo — esta manufacturando obsolescencia.

La velocidad de iteracion como ventaja competitiva

La economia del codigo barato no opera en un vacio. Opera en mercados donde la competencia tambien tiene acceso a las mismas herramientas, donde la ventana de oportunidad para un producto o funcionalidad se reduce, y donde la capacidad de aprender rapido del mercado es mas valiosa que la capacidad de ejecutar planes perfectos.

Aqui es donde la estructura organizacional deja de ser un tema interno y se convierte en un factor competitivo. Si tu competidor puede ir de hipotesis a experimento desplegado en horas mientras tu organizacion necesita un ciclo completo de sprint planning, grooming, desarrollo, review y QA para lograr lo mismo, estas operando con una desventaja estructural que ningun talento individual puede compensar.

Brooks (1975), en “The Mythical Man-Month,” demostro hace medio siglo que el overhead de comunicacion escala cuadraticamente con el tamano del equipo. Si un equipo de tres personas tiene tres canales de comunicacion, un equipo de diez tiene cuarenta y cinco, y un equipo de cincuenta tiene mil doscientos veinticinco. Cada canal representa posibilidad de malentendido, latencia en decisiones, y tiempo dedicado a coordinacion en lugar de produccion. Brooks argumento que agregar personas a un proyecto retrasado lo retrasa aun mas — no por incompetencia, sino por matematicas puras de comunicacion.

Lo que Brooks no previo — porque escribia en 1975 — es que la tecnologia eventualmente reduciria la necesidad de equipos grandes. Si un desarrollador asistido por IA puede producir lo que antes requeria un equipo de cinco, la organizacion puede operar con equipos de tres personas donde antes necesitaba quince. Y un equipo de tres personas tiene tres canales de comunicacion, no los ciento cinco que tendria un equipo de quince. El overhead de coordinacion se reduce exponencialmente, no porque la gestion sea mejor, sino porque hay menos nodos que coordinar.

Esto tiene implicaciones directas para la estructura gerencial. Si el equipo optimo se reduce de quince a tres personas, la capa de gestion que existia para coordinar a quince personas pierde su razon de ser. No necesitas un Engineering Manager, un Tech Lead, un Product Manager y un Scrum Master para gestionar a tres personas que iteran rapido. Necesitas a las tres personas y claridad sobre el objetivo.

Las organizaciones que entienden esto — startups en su mayoria, pero tambien algunos equipos dentro de grandes corporaciones — estan operando con ratios de produccion que parecerian imposibles hace cinco anos. Equipos de dos o tres personas construyendo productos completos. Ciclos de iteracion de horas, no semanas. Hipotesis de negocio probadas con codigo real en lugar de con presentaciones de PowerPoint.

Las organizaciones que no lo entienden siguen contratando PMs para gestionar backlogs de funcionalidades que un equipo pequeno podria construir y probar en paralelo. Siguen requiriendo tres niveles de aprobacion para un cambio de CSS. Siguen midiendo el exito en “stories delivered per sprint” cuando el indicador relevante es “hipotesis validadas por semana.”

La paradoja de la productividad: mas rapido no significa mejor sin direccion

Antes de continuar, es necesario abordar un contraargumento importante, porque la narrativa de que “la IA lo resuelve todo” es tan danina como la narrativa de que “siempre necesitamos las mismas capas de gestion.”

Becker et al. (2025), en un ensayo controlado aleatorizado con desarrolladores experimentados de codigo abierto, encontraron un resultado sorprendente: permitir el uso de herramientas de IA en realidad incremento el tiempo de completado de tareas en un 19%. Los desarrolladores, que antes de comenzar estimaron que la IA reduciria su tiempo un 24%, terminaron siendo mas lentos con ella. La razon: en proyectos maduros con codigo complejo y estandares de calidad estrictos, el tiempo ahorrado en generacion se perdia en verificacion, correccion de alucinaciones del modelo, y adaptacion del codigo generado al contexto especifico del proyecto.

Este resultado no contradice la tesis de este articulo — la refina. Lo que Becker et al. demuestran es que el valor de la IA no es uniforme: depende del contexto, de la complejidad del problema, y de la madurez del sistema. En proyectos greenfield, donde se esta construyendo desde cero y las restricciones son menores, la aceleracion es dramatica. En proyectos maduros con anos de historia y convenciones establecidas, la ganancia es menor y a veces negativa.

La implicacion para la estructura organizacional no cambia — se matiza. No es que toda gestion sea innecesaria. Es que el tipo de gestion necesaria cambia. La gestion que agrega valor no es la que filtra y aprueba (gatekeeping), sino la que proporciona contexto y direccion (enabling). Un equipo que itera rapido sin direccion estrategica produce codigo rapido sobre las hipotesis incorrectas. La velocidad sin vision es movimiento browniano — mucha actividad, cero progreso neto.

No es eliminar gestion — es reconfigurar su proposito

El argumento de este articulo no es que la gestion de software debe desaparecer. Es que debe transformarse. Y la distincion es fundamental.

En la economia del codigo caro, la funcion primaria de la gestion era prevenir: prevenir errores, prevenir desperdicio, prevenir que se construyera lo incorrecto. Esto se traducia en roles de filtrado — el PM filtraba requisitos, el arquitecto filtraba disenos, el reviewer filtraba codigo, el director filtraba asignacion de recursos. Cada rol era una puerta que se abria solo cuando se demostraba que pasar era seguro.

En la economia del codigo barato, la funcion primaria de la gestion deberia ser habilitar: remover obstaculos, proporcionar contexto, asegurar alineamiento estrategico, y crear las condiciones para que equipos pequenos itere rapido y aprendan del mercado. Esto no es una funcion menor — es una funcion diferente.

El Product Manager del futuro no prioriza un backlog de funcionalidades para proteger tiempo de desarrollo — proporciona contexto de mercado, articula hipotesis de negocio, y ayuda al equipo a interpretar los datos de los experimentos que ejecuta. Su valor no esta en decidir que se construye, sino en asegurar que lo que se construye se prueba contra las preguntas correctas.

El lider de ingenieria del futuro no asigna tareas ni revisa estimaciones — crea las condiciones tecnicas y culturales para que el equipo tenga autonomia. Asegura que la infraestructura de despliegue permita iteracion rapida, que las practicas de testing automatizado sean robustas, que el equipo tenga acceso a los datos que necesita para tomar decisiones. Su valor no esta en coordinar personas, sino en eliminar la necesidad de coordinacion excesiva.

El arquitecto del futuro no aprueba disenos antes de que se implementen — establece principios y constraints que el equipo usa para autoevaluarse. En lugar de revisar cada decision, define las reglas del juego y confia en que el equipo las aplicara. Su intervencion directa se reserva para decisiones genuinamente irreversibles, no para cada pull request.

Esta transformacion es analoga a lo que ocurrio en manufactura con la transicion de produccion en masa a lean manufacturing. En produccion en masa, los supervisores existian para inspeccionar calidad al final de la linea — la funcion era detectar y descartar defectos. En lean manufacturing, la calidad se construye en el proceso — la funcion del supervisor se transformo de inspector a coach, de alguien que detecta problemas a alguien que habilita al equipo para prevenirlos. Las organizaciones que hicieron esta transicion no eliminaron la gestion — la redefinieron.

Lo mismo aplica al software. No se trata de eliminar al PM, al director, al arquitecto. Se trata de reconocer que si su funcion primaria sigue siendo filtrar y aprobar — funciones disenadas para una economia de escasez — estan operando sobre un modelo obsoleto. Y un modelo obsoleto no es neutro: es un costo activo, porque la friccion que genera ralentiza la velocidad de iteracion, que es ahora la variable competitiva mas critica.

La inercia organizacional y por que el cambio es lento

Si la logica es tan clara, por que la mayoria de las organizaciones de software no han cambiado sus estructuras gerenciales?

Porque las estructuras organizacionales tienen inercia. Fueron construidas durante anos o decadas, estan codificadas en organigramas, titulos, bandas salariales, procesos de evaluacion de desempeno, y narrativas internas sobre “como hacemos las cosas aqui.” Cambiar una herramienta de desarrollo toma dias. Cambiar una estructura organizacional toma anos, si es que ocurre.

Ademas, las personas en las capas gerenciales tienen incentivos racionales para preservar la estructura actual. Un Director de Ingenieria con quince reportes directos no va a proponer voluntariamente que su equipo podria funcionar con tres personas autonomas y sin director. Un PM que ha construido su carrera siendo el arbitro de la priorizacion no va a sugerir que los equipos priorizaran solos. Esto no es cinismo — es comportamiento humano normal. Las personas protegen las estructuras que sostienen su identidad profesional y su posicion economica.

Tambien existe una asimetria de informacion. Los ejecutivos senior que deciden la estructura organizacional frecuentemente no estan al tanto de cuanto ha cambiado la economia del desarrollo. Siguen operando con modelos mentales de hace cinco o diez anos, donde contratar era dificil, el desarrollo era lento, y las capas de gestion eran el unico mecanismo para asegurar calidad y alineamiento. No ven — porque nadie les muestra — que un equipo de tres personas con las herramientas correctas puede superar en output y velocidad de aprendizaje a un equipo de quince con estructura gerencial completa.

Finalmente, el miedo al caos. “Si eliminamos las capas de gestion, todo sera un desorden” es una objecion comun. Y no es completamente infundada: sin estructura alguna, los equipos pueden derivar. Pero la alternativa a demasiada estructura no es ninguna estructura — es la estructura correcta para la economia actual. Equipos pequenos con autonomia, objetivos claros, acceso a datos, y liderazgo que habilita en lugar de filtrar.

El costo oculto de no adaptarse

Las organizaciones que no adaptan su estructura a la nueva economia del codigo enfrentan un costo que rara vez aparece en un balance: el costo de la oportunidad perdida. Cada semana que un equipo pasa esperando aprobaciones para un experimento que podria haber construido en un dia es una semana de aprendizaje perdido. Cada ciclo de sprint planning dedicado a estimar y priorizar funcionalidades que podrian probarse en paralelo es un ciclo donde la competencia esta aprendiendo mas rapido.

Este costo es invisible porque es contrafactual — no se ve lo que no se hizo. Nadie reporta “perdimos tres meses de aprendizaje de mercado porque nuestro proceso de priorizacion tarda seis semanas.” Pero la acumulacion de estos costos es lo que separa a las organizaciones que lideran de las que siguen. Weisz et al. (2024), en su estudio sobre el despliegue de asistentes de codigo en IBM, encontraron que aunque las herramientas proporcionaban incrementos netos de productividad, los beneficios no se experimentaban uniformemente — lo cual sugiere que las organizaciones que no adaptan sus procesos a las nuevas herramientas capturan solo una fraccion del valor disponible.

La velocidad de adaptacion organizacional se convierte asi en un meta-indicador competitivo. No solo importa que tan rapido tu equipo escribe codigo — importa que tan rapido tu organizacion puede reorganizarse alrededor de una nueva economia de produccion. Y las organizaciones con mas capas, mas procesos, y mas inercia se reorganizan mas lento.

Lo que viene: equipos de tres personas, no departamentos de cincuenta

Si proyectamos la tendencia actual, el futuro del desarrollo de software no se parece a lo que conocemos. No se parece a departamentos de ingenieria de cincuenta personas organizados en squads con PMs, tech leads, Scrum Masters y QA engineers. Se parece mas a celulas autonomas de dos a cinco personas — ingenieros senior asistidos por IA — que pueden concebir, construir, desplegar y evaluar un producto o funcionalidad completa sin intermediarios.

En este modelo, la gestion no desaparece pero se adelgaza drasticamente. En lugar de una jerarquia de Director > Senior Manager > Engineering Manager > Tech Lead > Developer, hay un lider de producto-ingenieria que establece direccion estrategica y tres o cuatro ejecutores con autonomia completa. La coordinacion entre celulas ocurre a traves de APIs y contratos, no de reuniones y tickets.

Este modelo no es utopico — ya existe en organizaciones que operan en la frontera. Lo que falta es que se normalice. Y se normalizara, porque las organizaciones que lo adopten produciran mas, aprenderan mas rapido, y responderan mejor al mercado que las que sigan operando con estructuras disenadas para la economia del codigo caro.

La pregunta incomoda

Toda organizacion que desarrolla software deberia hacerse una pregunta honesta, sin las capas de racionalizacion que protegen las estructuras existentes:

Cuantas capas gerenciales en nuestra organizacion existen porque el codigo era caro?

No cuantas capas existen. Cuantas existen por esa razon especifica — porque alguien, en algun momento, decidio que necesitabamos mas filtros, mas aprobaciones, mas coordinacion para proteger una inversion que ya no tiene el mismo costo.

La respuesta honesta, en la mayoria de las organizaciones, es: mas de las que estamos dispuestos a admitir.

Y la pregunta que sigue es aun mas incomoda: si esas capas existen por una razon que ya no es valida, que las sostiene? La inercia? Los incentivos? El miedo? La falta de imaginacion sobre como seria la alternativa?

El codigo ya no es caro. La pregunta es cuanto tiempo va a tomar que las organizaciones — y las personas dentro de ellas — actuen en consecuencia. Porque el mercado no espera a que los organigramas se actualicen. El mercado premia a quien aprende mas rapido. Y aprender rapido requiere estructuras ligeras, equipos autonomos, y la honestidad intelectual de reconocer cuando una estructura que alguna vez fue racional se ha convertido en un obstaculo.

Las organizaciones que hagan esta transicion no eliminaran la gestion. La elevaran. De guardianes del costo a habilitadores de la velocidad. De filtros protectores a amplificadores de impacto. De capas de burocracia a capas de inteligencia estrategica.

Las que no la hagan seguiran optimizando procesos para una economia que ya no existe, preguntandose por que equipos de tres personas en un garage siguen superando a departamentos de cincuenta con presupuestos millonarios.

La respuesta siempre fue la misma: porque el codigo ya no es caro. Y las estructuras que asumian que lo era se convirtieron en el verdadero costo.

Referencias

- Appanasamy, N. R. (2025). “The Evolution of Software Engineering in the Age of AI Collaboration: Opportunities, Challenges, and Future Implications.” International Journal of Advanced Research in Science, Communication and Technology. DOI: 10.48175/ijarsct-24610

- Becker, J., Rush, N., Barnes, E., & Rein, D. (2025). “Measuring the Impact of Early-2025 AI on Experienced Open-Source Developer Productivity.” arXiv preprint. ArXiv: 2507.09089

- Brooks, F. P. (1975). The Mythical Man-Month: Essays on Software Engineering. Addison-Wesley.

- Pandey, R., Singh, P., Wei, R., & Shankar, S. (2024). “Transforming Software Development: Evaluating the Efficiency and Challenges of GitHub Copilot in Real-World Projects.” arXiv preprint. ArXiv: 2406.17910

- Sankhe, P., Patil, N., Ghorpade, M., Prasad, P., & Linkesh, M. (2025). “Empirical Analysis of AI-Assisted Code Generation Tools Impact on Code Quality, Security and Developer Productivity.” International Journal For Multidisciplinary Research. DOI: 10.36948/ijfmr.2025.v07i06.61350

- Tabarsi, B. T., Reichert, H., Limke, A., Kuttal, S., & Barnes, T. (2025). “LLMs’ Reshaping of People, Processes, Products, and Society in Software Development: A Comprehensive Exploration with Early Adopters.” arXiv preprint. ArXiv: 2503.05012

- Weisz, J. D., Kumar, S., Muller, M. J., et al. (2024). “Examining the Use and Impact of an AI Code Assistant on Developer Productivity and Experience in the Enterprise.” CHI Extended Abstracts. ArXiv: 2412.06603